Redes de ordenadores y comunicaciones

|

Redes de ordenadores y comunicaciones | ||

Este tema está dirigido a usuarios de ordenadores no iniciados

en redes y comunicaciones. No es una introducción exhaustiva a las redes de

ordenadores, sin embargo aporta una base suficiente y razonable sobre los

conceptos generales y tecnologías comunes a la mayoría de redes y

comunicaciones.

Durante el siglo pasado se desarrollaron una gran

variedad de redes de comunicaciones, hasta alcanzar la situación actual, en la

que rodean el globo y se extienden por el espacio. La radio, la televisión y el

teléfono permiten que millones de personas estén en contacto, a menudo salvando

distancias de miles de kilómetros.

Aunque los primeros sistemas de

comunicación, como el telégrafo, utilizaban un código

digital

(el código Morse) para transmitir la información, el mayor peso de los

desarrollos necesarios para dar lugar a estas redes de comunicación ha ido

dirigido hacia la transmisión de voz e imagen, de forma analógica. Con la

llegada de los ordenadores, la situación ha cambiado de nuevo. La información se

envía en forma digital, cada vez en cantidades mayores. La combinación de

ordenadores y redes de comunicaciones es una de las principales áreas de

desarrollo en la actualidad, teniendo un impacto tan profundo en el estilo de

vida de millones de personas como lo tuvieron la radio y el teléfono en su

momento.

digital

(el código Morse) para transmitir la información, el mayor peso de los

desarrollos necesarios para dar lugar a estas redes de comunicación ha ido

dirigido hacia la transmisión de voz e imagen, de forma analógica. Con la

llegada de los ordenadores, la situación ha cambiado de nuevo. La información se

envía en forma digital, cada vez en cantidades mayores. La combinación de

ordenadores y redes de comunicaciones es una de las principales áreas de

desarrollo en la actualidad, teniendo un impacto tan profundo en el estilo de

vida de millones de personas como lo tuvieron la radio y el teléfono en su

momento.

Un proceso cualquiera de comunicación está constituido por un

EMISOR que envía INFORMACIÓN

a través de un CANAL de transmisión, la cual

es recibida por un RECEPTOR. Podemos por tanto,

hablar de comunicación oral, escrita, etc., donde el canal será respectivamente

el aire, el papel, etc.

La información no es transmitida directamente,

sino que se utilizan unos CODIGOS entendibles por el

emisor y el receptor, y que se comunica mediante SEÑALES físicas. Los códigos serán el lenguaje utilizado y

las señales las ondas sonoras, luminosas, etc.

En muchos casos, la

utilización de códigos y señales exigirá que la información sea CODIFICADA en la transmisión y DECODIFICADA en la recepción. Es decir, pueden ser

codificadores/decodificadores los sentidos, los traductores, etc.

El

objetivo de un proceso de comunicación es que la información que se quiere

transmitir sea idéntica a la que se recibe. Si falla cualquiera de los elementos

que intervienen (transmisor, canal de transmisión o receptor), se producen

pérdidas de información; para intentar evitarlo, se repiten los mensajes en su

totalidad o en parte (redundancia), o se acompañan de códigos especiales (de

control) que permitan reconstruir la información.

La comunicación suele

ser en ambas direcciones alternativa o simultáneamente, convirtiéndose el

transmisor en receptor y viceversa.

Lo dicho de una forma general lo

podemos extrapolar al mundo informático, con la intervención de diferentes

máquinas que comunicarán las informaciones a diversos tipos de receptores.

Las principales razones de ser de las comunicaciones informáticas

son:

Estas necesidades han conducido al gran desarrollo de las REDES

de comunicaciones. Veremos cómo es posible conectar ordenadores y terminales. Un

terminal puede ser "tonto" o inteligente. El primero consiste prácticamente en

un monitor y un teclado, y el segundo es un ordenador completo, es decir, se

diferencian en que el terminal inteligente posee capacidad de proceso de

información de forma autónoma.

Las redes se distinguen primeramente por

la distancia existente entre sus terminales, clasificándose en:

Como medio físico o canal de comunicación se usan el aire o

cables (par trenzado, coaxial y fibra óptica). No se puede hablar de uno mejor

que otro, sino de cuál es el más adecuado a cada necesidad y dependerá de las

prestaciones, coste, fiabilidad de instalación y capacidad de integración con

otros sistemas.

Se diferencian también por la velocidad de transmisión.

Esta se mide en bits por segundo frecuentemente confundida con baudios.

El baudio es una unidad de velocidad de señalización, o de modulación,

igual al número de condiciones discretas o símbolos que se suceden en la línea,

por segundo. La velocidad de transmisión en baudios coincide con la velocidad de

transmisión en bit/s, sólo si cada símbolo representa un bit. Un baudio es el

inverso del intervalo del pulso más corto de señalización medido en segundos.

Un modem que transmite bits a una velocidad de 2400 bit/s, mediante un

sistema de modulación cuaternario por modulación de fase, transmite 1200

símbolos por segundo, y por lo tanto la velocidad de modulación es de 1200

baudios. Un sistema que no emplee bit de parada ni de arranque tiene una

velocidad de transmisión en bit/s igual a la velocidad de modulación en baudios.

Un sistema de transmisión de 5 bit, con un pulso de arranque de 13.5 ms y un

pulso de parada de 19 ms, con una duración total par el carácter de 100 ms,

tiene una velocidad de señalización o modulación de:

El intercambio de información entre los distintos dispositivos

tiene que estar regido por unos PROTOCOLOS, o

lenguajes de diálogo que lo regulen. Consisten en un conjunto de normas comunes

para establecer la comunicación tanto para el receptor como para el emisor.

Desde el comienzo de la industria informática, cada fabricante intentaba idear

una serie de procedimientos, con los cuales podía controlar la información y así

monopolizar el mercado de las ventas de los distintos elementos que componen la

informática. Con el paso del tiempo esta industria se ha extendido tanto, que

surge la necesidad de compatibilizar los procedimientos de la información.

Actualmente existen asociaciones de fabricantes de ordenadores, y organizaciones

internacionales como por ejemplo ISO, que establecen

unas recomendaciones sobre los procedimientos normalizados de comunicación, que

van a gobernar ese intercambio de información. Un protocolo es pues, un conjunto

de procedimientos normalizados o estandarizados que gobiernan el intercambio de

comunicaciones, acuerdos o convenios que se adoptan para poder establecer una

comunicación correcta; afectan a las frecuencias de las señales, reconocimiento

de la conexión, código de recepción y emisión, control de errores, control de la

sincronía, inicio de las operaciones, establecimiento de los caminos por lo que

irán los mensajes, asegurar que los datos han sido recibidos, etc.![]()

8.2 ¿Qué es una red de ordenadores?

Una red

de ordenadores es una colección de máquinas que pueden almacenar y manipular

datos electrónicos, interconectadas de forma que sus usuarios pueden almacenar,

recuperar y compartir información con los demás. Las máquinas conectadas pueden

ser, microordenadores, miniordenadores, grandes ordenadores, terminales,

impresoras, dispositivos de almacenamiento, entre otros.

En una red de

ordenadores se puede almacenar cualquier información, incluyendo textos,

imágenes, mensajes de voz e imágenes visuales como por ejemplo fotos.

Como se ha visto las redes aportan beneficios, dándose seguidamente una

descripción de los más habituales:

A) Compartir

información de forma flexible.

Una red de ordenadores permite

a los usuarios compartir instantáneamente y sin esfuerzo la información.

Por ejemplo, un editor de libros, escritores, asociaciones de editores y

artistas pueden necesitar trabajar conjuntamente en una publicación. Mediante

una red pueden compartir los mismos archivos electrónicos, cada uno desde su

ordenador y transferir y copiar archivos. Estos pueden añadir material

simultáneamente a los ficheros, o eliminar partes, sin interrumpir el trabajo de

los demás. Las ventajas son evidentes.

B)

Libertad para elegir la herramienta adecuada.

Si se opta por

un entorno de red abierto, esto añade otra dimensión a las capacidades de

compartir información inherente a la red. Esto permite trabajar con el

equipamiento que más satisfaga a las necesidades del usuario. Por ejemplo en una

red abierta a los estándares internacionales, pueden estar trabajando unos

usuarios bajo entornos Windows de PCs, mientras que otros lo pueden estar

haciendo simultáneamente bajo UNIX®, en estaciones de trabajo o

incluso desde otros PCs.

C) Reducción de costos

al compartir equipamiento

Una razón muy importante para

disponer de una red de área local es el compartir equipamiento, lo cual implica

grandes beneficios. Por ejemplo, en una red de veinte microordenadores, se puede

disponer de una impresora laser de alta calidad y en color, para todo el

conjunto, por lo que el ahorro sería considerable frente a la opción de que los

veinte equipos no estuvieran conectados en red, e incluso dado el coste de este

tipo de impresoras sería económicamente inviable el que cada usuario tuviera una

de estas impresoras.

Lo mismo que se ha visto en el caso previo, de la

impresora de alta calidad, se puede concluir de otros dispositivos, como por

ejemplo un grabador de CD-ROM, un escaner en color de alta resolución o un

sistema de fax/modem. En una situación de red se puede compartir cada uno de

estos equipos, mientras que aisladamente sería improbable el que dispusiera cada

usuario de ellos.

D) Uso flexible de la potencia

de computación

Una de las ventajas más claras de una red, es

la posibilidad de usar la potencia de un equipo de la red, distinto al que

estamos trabajando. Por ejemplo si se han de realizar cálculos matemáticos o de

ingeniería complicados, se podrá acceder desde un punto de red, al equipo de

dicho entorno que tenga potencia y rapidez suficiente para realizar estos

trabajos en un tiempo razonable.

Otra alternativa es el procesamiento

paralelo, es decir resolver el problema de cálculo mediante el trabajo

simultáneo de varios equipos de la red. Algunos programas son demasiado

complicados para poder ejecutarse en microordenadores individuales, o tardarían

mucho tiempo, pero mediante el procesamiento paralelo entre los diversos equipos

de la red se aceleraría mucho el cálculo.

E)

Comunicación efectiva y fácil con todo el mundo

Mediante las

redes de área geográficas, se pueden interconectar redes de área local a escala

mundial. De esta forma se puede transferir información, prácticamente de forma

instantánea, a cualquier lugar. ![]()

8.3 Topología

de red y tipos de redes

8.3.1 Datos

frente a Información

Aunque rutinariamente se intercambian ambos

términos, técnicamente no son lo mismo. Datos son entidades con un significado

dado, son la forma de representar la información, pero no la información en sí

misma.

Para propósitos habituales la información son datos decodificados

en forma legible. Por ejemplo, los datos de un fichero se pueden decodificar y

mostrar en una pantalla de ordenador o trasladarlos a una impresora.

8.3.2 ¿Cómo se transfieren los datos en una

red?

Para transferir señales entre ordenadores se necesitan: un

medio de transmisión para portar las señales y dispositivos para enviar y

recibir las señales.

A) Medios de transmisión de

la red.

Las señales eléctricas se generan como ondas

electromagnéticas (señales analógicas) o como una secuencia de pulsos de

voltajes (señales digitales). Para propagarse, una señal debe viajar a través de

un medio físico, el llamado medio de transmisión. Hay dos medios de transmisión,

guiados y no guiados.

Los medios guiados se fabrican de forma que las

señales se confinan a un canal de transmisión estrecho y que se puede predecir

su comportamiento. Son habituales, los cables de par trenzado (como lo

telefónicos), cables coaxiales (como los de las antenas de televisión) y cables

de fibra óptica. Ver apéndice sobre cables al final del tema.

Los medios

no guiados son partes del entorno natural, a través de los que se transmiten las

señales bajo forma de ondas. Las frecuencias habituales se corresponden con el

espectro de radioondas (VHF y microondas) u ondas de luz (infrarrojo o visible).

Para planificar una red de ordenadores, se exige un medio de

transmisión, o combinación de ellos, basándose en las circunstancias físicas, a

la construcción de la red y las prestaciones que se requieren de ella. Un

objetivo habitual es guardar el coste al mínimo, sobre la base de las

necesidades planteadas.

B) Dispositivos de

transmisión y recepción.

Una vez que se tiene un medio de

transmisión, se necesitan los dispositivos que propaguen y reciban las señales a

través del medio elegido. Estos pueden ser, adaptadores de red, repetidores,

concentradores, transmisores diversos y receptores.

Adaptadores de red

Se fabrican de diversas formas,

la más habitual es una placa de circuito impreso que se instala directamente en

un zócalo de expansión del ordenador. Otros están diseñados para

microordenadores portátiles, por lo que consisten en un dispositivo pequeño, que

se conecta a la salida de impresora o a una ranura PCMCIA. Estos adaptadores se

fabrican en diversas versiones, de forma que se puedan conectar a cualquier tipo

de medio guiado. También se pueden conectar a dispositivos que puedan transmitir

mediante medios no guiados

Repetidores y Hubs

Se usan para incrementar las distancias a las que se puede propagar una

señal de red. Cuando una señal viaja a través de un medio encuentra resistencia

y gradualmente se hace más débil y distorsionada. Técnicamente este proceso se

denomina atenuación.

Puentes (Bridges)

Permiten conectar una LAN a otra red con diferentes protocolos en los

niveles físico y de enlace, pero siempre que en los niveles superiores usen los

mismos protocolos.

Pasarelas (Gateways)

Se usan para conectar una LAN a otra red que utilice otros protocolos.

Se emplean para conexión entre diferentes redes locales, o entre locales y

ampliadas (WAN).

Concentradores

Se

usan en redes de microordenadores para proporcionar un punto común de conexión

para dispositivos de computación. Todos los concentradores tienen repetidores

Transmisores de microondas

Los

transmisores y receptores de microondas, especialmente satélites, se usan para

transmitir señales a grandes distancias. El medio de transmisión es la

atmósfera. En EE.UU las principales bandas de Microondas autorizadas para

telecomunicaciones fijas están en el rango de frecuencias de 2 GHz a 40 GHz. Las

licencias están concedidas para subrangos inferiores, por ejemplo el Gobierno

Federal tiene una en el rango de 7.125 a 8.40 GHz, mientras que el rango de

10.550 a 10.680 está adjudicado a un usuario privado. A continuación se muestra

un esquema del espectro electromagnético completo:

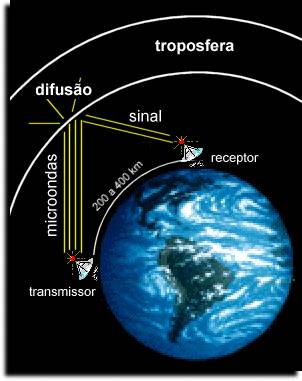

La siguiente

figura muestra el proceso de transmisión que sufren las microondas en la

atmósfera,

Transmisores infrarrojos y

láser

Son análogos a los de microondas. También usan la atmósfera

como medio, sin embargo; sólo son válidos para distancias cortas, ya que la

humedad, niebla, obstáculos y otros fenómenos ambientales pueden causar

problemas de transmisión.

Como ejemplo de transmisión

mediante radiación láser, se puede citar el equipo Canobeam de la empresa

japonesa Canon. Entre las características de este sistema, destacan:

Las redes de área personal (WPAN) como tecnología de tercera

generación, significan un impulso al proceso de convergencia entre las

industrias informática y de comunicaciones. Desde el momento en que los

teléfonos móviles se empiecen a utilizar masivamente como ordenadores se

producirá una reestructuración del mercado. Los sectores de GPS, telefonía

móvil, ordenadores y en general procesadores, dejarán de ser sectores

independientes. Estas redes trabajan en una banda de frecuencias que no necesita

licencia, 2.4 GHz.

Las interferencias constituyen un problema en la tecnología radio en general que se manifiesta activamente en VLAN y también en distancias cortas o WPAN por cuanto trabaja en la banda sin licencia IMS de 2.4 GHz, como la iluminación de estadios y los hornos de microondas tanto dornésticos como industriales. En particular. es de gran relevancia la problemática ligada al efecto de las interferencias en sistemas de radio producidas por los hornos de microondas. El dispositivo fundamental de un horno de microondas es, en lo que respecta a interferencias, el magnetrón de cavidades resonantes. El rnagnetrón cs un tubo oscilador empleado típicamente como oscilador de potencia en el transmisor de los sistemas de radar. En este tubo, el flujo de electrones desde el cátodo al ánodo se controla por medio de un campo magnético creado por un sistema de bobinas o bien un imán permanente ubicado en el magnetrón. El comportanicnto de un magnetrón se puede analizar con relativa facilidad mediante procedimientos gráficos que, en esencia, se reducen a dos tipos: diagrama que relaciona mutuamente la intensidad de campo magnético, la corriente en el magnetrón, la variación de frecuencia, y la tensión cntre ánodo v cátodo, así como cl rendimiento; y diagrama de Rieke, que proporciona la relación existente entre la impedancia de carga y la frecuencia, por un lado, y el rendimiento, por otro Estos magnetrones de hornos de microondas son equipos de pequcña potencia en comparación con los magnetrones utilizados en radar. Tipicamente, la potencia de salida de un rnagnetrón de horno de microondas está comprendida aproximadamente entre 650 y 3000 watios. Los hornos de microondas pueden emitir legalmente niveles significativos de fugas en las bandas ISM dentro de los límites establecidos por las normas de seguridad internacionales. Cualquier utilización de sistemas de radio en estas handas se debe basar, por tanto, en acuerdos ad hoc con la industria de las comunicaciones. Un aspecto clave del tema de las interferencias en este contexto viene dado por el hecho de que magnetrones y hornos de microondas se diseñan para que funcionen en la región del diagrama de Rieke, donde tiene lugar la intersección de todas las lineas de frecuencia. |

Un ejemplo es el consorcio Bluetooh, que es un grupo de

inetreés especial y consorcio promotor que agrupa a fabricantes en estos campos.

Bluetooh es una tecnología desarrollada por Ericsson, que se aplica a todos los

dsipositivos que conforman el escenario inalámbrico, para usuarios: ordenadores

portátiles, teléfonos y dispositivos de mano, como por ejemplo PDA (asistentes

digitales personales).

El usuario, en el futuro, ya no utilizará un

teléfono, un ordenador portátil o alguno de lso dispositivos presenets en el

mercado, sino un equipo comunicador.

BLUETOOTH La tecnología Bluetooth se implementa en un chip que se integra en los diferentes equipos que conforman el entorno inalámbrico actual, como ordenadores portátiles, periféricos (ratón, impresoras...), PDA (Personal Digital Assistants) o teléfonos móviles, así como el futuro, en el que se contemplan, además de estos equipos clásicos del ámbito de la comunicación y 1a informática, otros del ámbito de la domótica. Se tiene así lo que se conoce como productos Bluetooth o Bluctooth enabled. El punto clave del chip es el transceiver o transceptor, que ha de ser de muy pequeño tamaño (para no aumentar el tamaño del chip y poder integrarlo con facilidad en los productos) y de muy baja potencia. Otra parte del chip es el circuito integrado de radiofrecuencia. Este circuito integrado tiene capacidad de autorregulación, lo que confiere un factor de ahorro de potencia, característica que es consustancial a las tecnologías inalámbricas en distancias cortas. En concreto, en el chip Bluetooth el consumo es menor del 3% de la potencia que consume un teléfono móvil. El mecanismo de autorregulación funciona de la siguiente forma: cuando se detecta un receptor a una distancia corta el transmisor del circuito integrado es capaz de alterar la potencia de su propia señal para adaptarla al nivel adecuado; cuando se interrumpe la transmisión o disminuye e1 tráfico el sistema pasa a un estado de baja potencia. En esté estado la verificación de conexión se realiza mediante una serie de señales cortas, es decir, se detectan, de forma periódica, los mensajes de búsqueda. Bluetooth utiliza spread spectrum, en concreto frequency hopping (salto de frecuencia). Estos sistemas de salto de frecuencia dividen la banda de frecuencia en varios canales de salto (hopping). En el transcurso de una conexión se produce una transición brusca o salto de los transceptores de radio de un canal a otro de modo pseudoaleatorio. En sistemas FH, el ancho de banda instantáneo es relativamente reducido, si bien, hablando en términos generales, la dispersión o spread se obtiene a lo largo de la banda de frecuencias completa. Esto da lugar a transceptores de banda estrecha y de coste reducido que se pueden considerar óptimos en ley relativo a inmunidad frente a perturbaciones. Para soslayar este factor se dispone de programas de corrección de errores cuya misión es el restablecimiento de los bits de error. Los enlaces en la capa de banda base de la pila de protocolos en Bluetooth, es decir, los posibles enlaces físicos son SC() (´Synchronous Connection Oriented´) para voz y ACL ('Asynchronous Connectionless Link´) para paquetes de datos. Los paquetes ACL se utilizan únicamente para información en forma de datos, mientras que SCO utiliza paquetes que contiene solamente audio o bien una combinación de audio y datos. Los paquetes en Bluetooth son de formato fijo: contienen un campo de código de acceso con el que se identifica el paquete, una cabecera dedicada a información de control y un campo de carga alternativo. La codificación de voz se realiza mediante la técnica de modulación CVSD (Continuoslv Variable Slope Delta) o modulación continua de inclinación delta, con lo que se consigue un buen nivel de inmunidad a errores de hit, que aparecen como un ruido de fondo. Los mecanismos de seguridad consisten en esquemas de autenticación (el proceso de probar la identidad de un cliente/usuario) basados en un mecanismo de exigencia-respuesta y de encriptación hasacla en cifrado el nivel básico. Bluctooth funciona en una topología de varias picorredes (redes de corto alcance) con las que se pueden obtener conexiones punto a punto y punto a multipunto. De momento, se ha conseguido crear y enlazar de forma ad-hoc hasta 10 picorredes, donde todos los equipos que se encuentran en una misma picorred aparecen sincronizados. El concepto de picorred es clave en Bluetooth: se define como la red formada por dos o más unidades o equipos que compraten un canal. Una unidad controla el tráfico y las otras funcionan como elementos subordinados. Las picorredes pueden, a su vez, enlazarse siguiendo una arquitectura tipica del escenario inalámbrico que se utiliza habitualmente para generar flujos de comunicación mutua entre equipos inalámbricos y que normalmente se crea de forma espontánea sin necesitar un punto de acceso como parte integrante de la red. Un grupo de picorredes enlazadas constituye una red de dispersión. El ancho de banda asociado a Bluetooth, que es de un Mbps, puede llegar a extenderse hasta incluso más de seis Mbps con una topología de 10 picorredes enlazadas. El enlace de radio físico entre las diferentes unidades que forman una picorred se realiza mediante los protocolos que conforman las capas de banda base y de enlace. |

| Para líneas xDSL hay cuatro tipos de posibilidades: DSL asimétrico (ADSL), en el que las velocidades de transmisión son distintas según el sentido. DSL simétrico (SDSL), en el que las velocidades en ambos sentidos son análogas DSL de elevada relación de bits, (HDSL) es como el simétrico, pero con más velocidad (HDSL2) DSL de muy elevada relación de bits, (VDSL) es análogo a ADSL; pero al velocidad está en función de la red. Se alcanzan velocidades de hasta 60 Mbit/s Los principales fabricantes de circuitos integrados para estos dispositivos son: Alcatel Microelectronics, STMicroelectronics, Analog Devices Inc, Lucent Technologies Inc, Globespan Technologies Inc, Virata Corp. y ARM Holding Plc. |

8.3.4 Principales tipos de redes

Al hablar de "hardware" de red no hay más remedio que hablar de las

implementaciones que existen en el mercado de ciertas normas creadas por el IEEE

(Institute of Electrical and Electronics Engineers). Cada una de estas normas

engloba toda una serie de características entre las que destacan la topología,

velocidad de transferencia y tipos de cable. Para no entrar en temas

excesivamente técnicos se describen tres: Arcnet, Ethernet y Token Ring.

ARCNET: Aunque existe una versión de esta red

que utiliza topología bus, la más conocida utiliza topología de estrella

distribuida. Soporta una velocidad de 2.5 Mbit/s suficiente para redes de tamaño

medio. Debido a que tiene un coste bajo y es muy fácil de instalar es el

hardware de red más utilizado en redes pequeñas, aunque cada vez se usa menos.

Sin embargo, por su velocidad y las distancias que soporta, es ideal para redes

medias. Utiliza cable coaxial y soporta una distancia máxima de 6 km.

ETHERNET: Utiliza topología bus. Como su

velocidad de transferencia es alta (10 Mbit/s y las versiones más modernas 100

Mbit/s) puede ser utilizada en redes medias e incluso grandes. Pero, debido a su

método de acceso, las prestaciones pueden caer si el tráfico es muy intenso. Por

ello es recomendable estudiar el tipo de aplicaciones que se van a utilizar en

la red. Fue el primer hardware de red presentado en el mercado, siendo ahora el

más popular. La mayoría de fabricantes de ordenadores tienen implementaciones

sobre Ethernet y gracias a ello, la conectividad con esta red es muy fácil.

Utiliza cable coaxial de dos tipos y en su versión más moderna (10 Base T),

cable UTP. Recomendada para entornos en los que deba convivir con equipos

Digital o comunicaciones TCP/IP Para obtener amplia información sobre esta red

se recomienda visitar la página web de Charles

Espurgeons. Si se desea más información se puede acceder al tutorial de la

empresa Lantronix.

TOKEN RING: Es la red IBM por excelencia.

Cuenta con versiones de 4 y 16 Mbit/s lo que la hacía hasta hace poco tiempo una

de las más rápidas. Por su velocidad y soporte de grandes distancias, es la más

utilizada en redes grandes. Utiliza topología en anillo aunque en realidad el

cable se hace en estrella. Ideal para conectividad con IBM. No se recomienda

para redes muy pequeñas ya que su coste es alto con respecto a las otras dos.

8.3.5 Sistemas Operativos de red

Vistos los diversos niveles OSI,

se puede concluir que hay una complejidad elevada en las tareas de control de

las comunicaciones en una red. El programa que realiza esta tarea se denomina

Sistema Operativo de Red, y ha de cumplir ciertos requerimientos:

8.4 El teléfono y la telefonía

móvil

El Sacerdote Francés Gauthey, en 1680, propuso a

la Academia de Ciencias de París, un sistema de transmisión de la voz humana

mediante tubos acústicos.

En 1860 el Alemán Phillipp Reis inventó un

aparato al que denominó "Teléfono" (del Griego "hablar a lo lejos") con el cual

logró transmitir sonidos durante breves intervalos de tiempo.

A modo de

curiosidad se dice que el inventor del teléfono fue el monje benedictino

Gauthey, que habiendo detectado la propagación de los sonidos por tubos

metálicos, realizó en 1783 los primeros ensayos de telefonía, empleando como

conductor la tubería de la bomba de vapor de Chaillot, de muchos kilómetros de

longitud.

El 14 de Febrero de 1876, el americano de origen irlandés,

Alexander Grahan Bell presentó una petición de patente de un teléfono, dos horas

antes de que lo hiciera Elisha Gray con un aparato similar.

El receptor no presentó problemas, aunque sí el emisor. La razón es

que el teléfono se basa en el principio de que una corriente contínua puede

variarse por una resistencia que lo haga en función de las ondas acústicas que

reciba (micrófono) lo que a su vez da lugar a la producción de las mismas en el

receptor (un electroimán con una lámina fina). Fueron muchos los experimentos

para lograr un micrófono eficaz, en 1878 Henry Hummings patentó uno que

consistía en una cavidad parcialmente rellena de carbón que cerraba el circuito

eléctrico, cuya resistencia y por tanto la intensidad que circula por el mismo

es proporcional a la presión de las ondas sonoras, actualmente aún se sigue

utilizando. Es de destacar que Tomas A. Edison

(1847-1931) también contribuyó con inventos al desarrollo del teléfono.

Otros elementos básicos del teléfono son el timbre o

campanilla y el marcador. El primero es un electroimán doble, con una armadura

pivotante que soporta a un martillo que al vibrar golpea a una campana, fue

descubierto por T. Watson y aún sigue en uso, el dial se inventó en el año 1896,

por unos asociados de Strowger.

Los primeros teléfonos incluían su

propia batería para alimentar el circuito, pero en 1894 se impuso la batería

central con un voltaje de 48 V, en uso desde entonces. Al descolgar el auricular

se produce el cierre del circuito y pasa por él una corriente continua,

indicando a la central que se requiere servicio.

En

España se estableció el teléfono en el año 1877 en Barcelona, traídos desde

Cuba, ya que se importaban directamente de EE.UU.. En 1884 el estado se hace

cargo del monopolio, en 1924 se crea la Compañía Telefónica Nacional de España,

actualmente denominada Telefónica de

España.

En las primeras centrales telefónicas las conexiones entre

usuarios se realizaban directamente por los operarios de la central, lo cual era

muy limitado, pues en cuanto crecía el número de abonados el número de

conexiones era inmanejable. En 1889 Almon B. Strowger, un enterrador de la

ciudad de Kansas, al creer que las llamadas eran desviadas a la competencia, por

parte de los operadores, inventó un sistema automático para la selección del

destinatario. Este principio se ha utilizado muchos años, hasta la aparición de

las centrales electrónicas.

Como ejemplo de un servicio avanzado de

comunicaciones se puede citar el sistema Ibercom de Telefónica de España. Es un

sistema de transmisión de voz y datos dirigido al sector institucional y

empresarial, soportado por tecnología enteramente digital. Permite a los

usuarios disponer de su propia red dentro del sistema Ibercom, haciendo uso

exclusivo de ciertos elementos de transmisión y conmutación, creándose una red

privada virtual (RPV).

La infraestructura básica de Ibercom está

compuesta por dos partes, una es la de acceso cuya función es la de proporcionar

las líneas de voz y datos a sus usuarios, denominada Red de Acceso Ibercom

(RAI), pudiendo estar compuesta de varios Módulos de Red de Accesos Ibercom

(MRAI) distribuidos, a los que se conectan todos los terminales correspondientes

a los servicios de telecomunicación con los que se desee dotar cada dependencia,

y otra, la de interconexión, que está incorporada en la porción de tránsito en

las redes públicas, y a la cual se accede a través de un Centro Frontal (CF),

que realiza el tránsito entre las RAI a él conectadas.

La central

telefónica del organismo que tenga este servicio, es una Ericson MD110, que

consta básicamente de unos módulos denominados Módulos de Interface de Línea

(LIM) controlados por un microprocesador equipado con todos los elementos

necesarios para el tratamiento de las llamadas pudiéndose conectar directamente

dos de ellos o a través del Selector de Grupo (GS) en caso de sistemas mayores.

Cada LIM puede funcionar como un sistema autónomo o como integrante de otro

mayor, realizando la conmutación a un ritmo de 64.5 Mbps, y albergando unas 250

extensiones de voz y datos.

La conexión entre los RAI y el CF se realiza

mediante uno o más enlaces MIC, a 2 Mbps, con cables trenzados, coaxiales, fibra

óptica o radioenlaces.

Los servicios ofrecidos por Ibercom son:

8.4.2 Telefonía Móvil

A) Introducción

En la evolución de las redes de

telecomunicación, una estrategia actual es dotar a los usuarios de movilidad, de

forma que puedan establecer una comunicación desde cualquier lugar. Ello es

posible mediante el empleo de la radio para establecer el enlace entre los

elementos a comunicarse. Como ejemplo usuales se pueden considera los sistemas

GSM y DECT. Seguidamente se describe el concepto "celular" por ser la base de la

mayoría de los sistemas de telefonía vía radio.

Al principio de los

sistemas celulares fueron creados por los laboratorios Bell (AT&T) hace unos

cincuenta años. Un sistema celular se forma al dividir el territorio al que se

pretende dar servicio, en áreas pequeñas o celdas (normalmente hexagonales), de

menor o mayor tamaño, cada una de las cuales está atendida por una estación de

radio. A su vez las células se agrupan en "clusters" o racimos, de forma que el

espectro de frecuencias se pueda utilizar en cada célula nueva, teniendo cuidado

de evitar las interferencias.

Las estructuras que permiten, de forma

ininterrumpida, la cobertura de una zona determinada son configuraciones a modo

de panal de miel basadas en 4, 7, 12 o 21 células.

El número total de

canales por célula se obtiene por la fórmula siguiente, N=(N´ total de

canales)/(Claustro (4, 7, 12, 21). Al ser menor el tamaño de las células mayor

será el número de canales que soporte el sistema.

La siguiente tabla

muestra la primera generación de sistemas celulares analógicos

|

|

|

|

|

| AMPS | EE.UU. |

832 |

30 |

| C-450 | Alemania |

573 |

10 |

| ETACS | Reino Unido |

1240 |

25 |

| JTACS | Japón |

800 |

12.5 |

| NMT-900 | Escandinavia |

1999 |

12.5 |

| NMT-450 | Escandinaviabm |

180 |

25 |

| NTT | Japón |

2400 |

6.25 |

| Radiocom-2000 | Francia |

560 |

12.5 |

| RTMS | Italia |

200 |

25 |

| TACS | Reino Unido |

1000 |

125 |

Respecto a los sistemas digitales, los más difundidos son los

siguientes:

GSM y DCS-1800, en Europa, IS-54 e IS-95 en EE.UU. y PDC

en Japón

B) Sistema NMT

Las primeras

generaciones de este tipo de comunicaciones eran sistemas analógicos, tales como

NMT, TACS, AMPS, etc., con una amplia difusión. Actualmente han surgido sistemas

digitales, como el GSM en Europa, el DAMPS en EE.UU. y JDC y PHP en Japón.

En España la telefonía móvil automática o TMA apareció en el año 1982 en

la modalidad de 450 MHz, tomando como referencia el modelo nórdico NMT. Debido

al éxito del mismo y a la saturación del espectro, Telefónica implantó la

modalidad de 900 MHz.

El sistema NMT (Nordic Mobile Telephony) surgió en

los países escandinavos en 1981, es ideal para cubrir la mayor extensión de

terreno con la menor inversión. La versión NMT 900 permite un mayor número de

canales.

C) Sistema TACS

El sistema

TACS 900 adaptado en Inglaterra el año 1985, deriva del sistema analógico AMPS

americano desarrollado por los laboratorios Bell y comercializado en EE.UU en

1984. Con este sistema se obtiene una mejor calidad del servicio, al mismo

tiempo que mejora la relación señal/ruido por tener una mayor anchura de canal.

Además precisa de equipos más pequeños y baratos.

El sistema TACS (Total

Access Communications System) 900 conocido como TMA 900, es del mismo tipo que

el anterior, analógico multiplexado en frecuencia, pero diferente por utilizar

una tecnología mucho más avanzada y barata, dando mejor calidad de audio, así

como una mejor conmutación al pasar de una a otra célula, ya que la señalización

se realiza fuera de banda, al contrario que NMT, que lo hace dentro de ella,

resultando casi imperceptible el ruido para el usuario, sin embargo sus

estaciones base cubren un rango menor. Emplea la banda de frecuencia de los 900

MHz y cada MHz se divide en 40 semicanales de 25 kHz, por lo que resulta

extremadamente útil, por su gran disponibilidad de canales, para cubrir áreas

urbanas. Dispone de 1320 canales duplex, de los que 21 se dedican exclusivamente

a control (señal digital) y el resto para voz (señal analógica)

D) Sistema GSM

El GSM (Groupe

Spécial Mobile), surge del intento europeo de unificar los 10 sistemas

diferentes existentes, en uno solo, el CEPT (año 1982).

La

principal ventaja de este sistema es que permite realizar o recibir llamadas en

cualquier país europeo, aún estando en tránsito por ellos; el teléfono se

registra automáticamente en la siguiente red GSM al cambiar de un país a otro,

quedando disponible para su utilización. Al ser criptografiadas todas las

conversaciones, da una gran ventaja, la mayor seguridad frente a escuchas. Otras

ventajas son su menor consumo de energía, las células más pequeñas y la

utilización del espectro de forma más eficiente

MoviStar

El

sistema básico MoviStar incluye el servicio de telefonía móvil, más otras

facilidades y funcionalidades como itinerancia internacional, desvío de

llamadas, buzón de voz, consulta al buzón de voz desde el extranjero, servicio

de recepción y envío de mensajes breves de hasta 160 caracteres en el móvil,

restricciones de llamadas, indicación de llamadas en espera, retención de

llamada, agenda electrónica, facturación detallada, identificación de la línea

llamante, ocultación de identidad, multiconferencia, indicación del coste de la

llamada, límite de crédito o fijación del consumo máximo, números de marcación

fija.

MoviStar Datos añade además las siguientes prestaciones,

comunicación de datos hasta 9600 bit/s, acceso a las redes de paquetes (Iberpac

y UNO) vía X28 y a Internet/Infovía.

MoviStar Fax añade a las funciones

básicas las comunicaciones vía fax de hasta 9600 bit/s.

MoviStar

Corporation, incluye las líneas MoviStar de una empresa en la red privada de

comunicaciones de la misma, permitiendo tratar los móviles como extensiones de

la centralita.

MoviStar Grupo Cerrado, permite a las PYMES formar un

grupo cerrado con todas las líneas MoviStar, de forma que no puedan llamar o ser

llamados fuera del grupo.

Actualmente con más de 9000 antenas cubre casi

toda la población española.

A continuación se muestra un mapa de

cobertura de Vodafone

La existencia

de competencia por parte de otras operadoras, Vodafoner, y Amena ha dado lugar a que las tarifas de

MoviStar sean más ventajosas que las de la telefonía móvil analógica, donde sólo

opera Moviline.

Próximamente va a aparecer

comercialmente una nueva tecnología universal, UMTS.

EN

España se han adjudicado 4 licencias a las operadoras Airtel Móviles, Amena,

Telefónica Móviles y Xfera, estando prevista su entrada en funcionamiento a lo

largo del año 2002

El siguiente enlace es al Libro

Blanco sobre UMTS

A la red actual GSM se le irán añadiendo nuevas

funcionalidades, antes de la implantación completa de UMTS. Nuevas tecnologías

como HSCSD, GPRS y EDGE

HSCSD (High Speed Circuit Switched Data)

se basa en circuitos conmutados de alta velocidad, proporciona una velocidad de

58 kbit/s. Permite acceder a varios servicios simultáneamente. Es parecida a la

actual RDSI.

GPRS (General Packet Radio

Service) puede llegar a velocidades de 115 kbit/s. Al contrario que HSCSD

que para su implantación requiere únicamente de actualización software, GPRS

necesita de un hardware específico para el enrutamiento a través de una red de

datos.

EDGE (Enhaced Data rates for GSM Evolution) nos acerca a

las capacidades que otorga 3G en la comunicación. En combinación con GPRS puede

alcanzar velocidades de 384 kbit/s

En la transición se necesitarán por

tanto terminales capaces de acceder a ambas redes.

Hasta el momento las

empresas de desarrollo y creadoras de contenidos están volcadas en es desarrollo

de aplicaciones WAP ya que se prevee su expansión en un corto periodo de tiempo.

Además que la aparición inminente del GPRS ayudará a relanzar mucho más el

acceso a aplicaciones móviles a través de Internet.

WAP acerca a los

usuarios a la utilización de servicios de internet, el posicionemiento en esta

tecnología ayudará al éxito en el desarrollo de proyectos UMTS. Por lo tanto no

hay que ver únicamente a WAP como una tecnología pasarela a UMTS sino que además

es una introducción de todas las partes (usuarios, operadoras, empresas, etc..)

a servicios móviles en redes.

Nuevos negocios se podrán implementar para

esta tecnología, que van desde los propios fabricantes de dispositivos hardware,

que desarrollarán los nuevos teléfonos y dispositivos capaces de aprovechar el

nuevo método de comunicación a los propios desarrolladores que se les abrirán

nuevas posibilidades que hasta ahora son inpensables de creación de contenidos,

aplicaciones, etc...

Mediante un conjunto de "Chips" se puede convertir un móvil en un control

remoto universal para aparatos electrodomésticos. Proximamente se comercializarán móviles con esta

capacidad.![]()

8.5 Sistema de

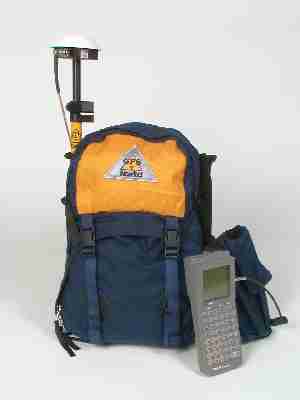

Posicionamiento Global (GPS)

8.5.1

Introducción histórica

Cuando la Unión Soviética puso en órbita

el primer satélite artificial de la Tierra, se observaba como un puntito

brillante, que se movía lentamente entre los astros que servían de punto de

referencia para los navegantes. Pronto surgió una idea, pasar de la navegación

estelar a la por satélite. Un grupo de científicos soviéticos, dirigidos por el

académico V. Kotélnikov, ofrecieron utilizar el método Doppler para determinar

los parámetros de las órbitas de los satélites.  El 3 de Marzo de 1978, la URSS puso en marcha el satélite Cosmos

1000, dando inicio al sistema de navegación cósmica nacional, "Tsikada",

destinado a localizar a los barcos en cualquier lugar del océano. Actualmente

hay varios satélites con esta misión.

El 3 de Marzo de 1978, la URSS puso en marcha el satélite Cosmos

1000, dando inicio al sistema de navegación cósmica nacional, "Tsikada",

destinado a localizar a los barcos en cualquier lugar del océano. Actualmente

hay varios satélites con esta misión.

Con este esquema de satélites, se

pueden obtener datos, en el ecuador cada 72 minutos y en latitudes altas más a

menudo, y en las latitudes norteñas, donde las órbitas se cruzan,

ininterrumpidamente. En los barcos se instala un microprocesador, que se conecta

al sistema de radionavegación tradicional

El uso de este sistema,

proporcionaba, hace unos años, el ahorro del orden de unos 25000 rublos al año,

por barco, en la URSS (Actualmente desaparecida).

Posteriormente se

implantó en la URSS el Sistema de Satélite de Navegación Global (SSNG), para la

localización exacta de barcos, automóviles y otros objetivos.

En el año

1986, la URSS y los EE.UU., declararon a la Organización Marítima Internacional,

que se podían explotar estos sistemas con fines pacíficos. Este sistema se ha

desarrollado desde entonces, quedando completo el año 1995. Consta de 24

satélites, de los que tres son de reserva, situados en tres planos orbitales, a

20200 km de altura, con un ángulo de 120 grados; uno respecto al otro. Las

señales de navegación se emiten en una banda de 1602.2 a 1615 MHz. Además estos

satélites pueden servir a una cantidad ilimitada de usuarios. Actualmente este

sistema está gestionado por el Ministerio de Defensa de EE.UU.

Este es

el origen del Sistema de Posicionamiento Global "GPS", en amplio desarrollo

actualmente, cuyo predecesor, el SSNG, puede seguir usándose, mediante un módulo

adicional.

A muchos navegantes y topógrafos acostumbrados a trabajar con

los métodos tradicionales, el posicionamiento de posición con sólo pulsar un

botón, les debe de parecer sorprendente. Pues bien, existe actualmente una forma

más avanzada del GPS, que optimiza aún más los límites de la precisión.

Este avance se conoce como GPS diferencial "DGPS", y con él se puede

medir fiablemente una posición hasta cuestión de metros, y en cualquier lugar

del planeta.

8.5.2 GPS Básico

Este

sistema se basa en 24 satélites orbitando a más de 20000 km de altura. Estos

actúan como puntos de referencia a partir de los cuales "triangulan" su posición

unos receptores en la Tierra. En cierto sentido es como una versión en alta

tecnología de la vieja técnica de los "boy scouts" o bandas análogas,

consistente en tomar marcaciones mediante una brújula desde las cumbres de los

montes cercanos para situar un punto en el mapa.

Los satélites actúan como puntos de referencia al ser

supervisadas sus órbitas con gran precisión desde estaciones terrestres. Mediante una

medición del tiempo de viaje de las señales trasmitidas desde los satélites, un

receptor GPS en tierra determina su distancia desde cada satélite. Con la

medición de la distancia desde cuatro satélites y la aplicación de cálculo

matemático, el receptor calcula, latitud, longitud, altitud, derrota y

velocidad. Los buenos receptores tienen una precisión menor que 100 m, y

efectúan más de una medida por segundo.

precisión desde estaciones terrestres. Mediante una

medición del tiempo de viaje de las señales trasmitidas desde los satélites, un

receptor GPS en tierra determina su distancia desde cada satélite. Con la

medición de la distancia desde cuatro satélites y la aplicación de cálculo

matemático, el receptor calcula, latitud, longitud, altitud, derrota y

velocidad. Los buenos receptores tienen una precisión menor que 100 m, y

efectúan más de una medida por segundo.

Los receptores pueden hacerse con

antenas muy pequeñas, de hecho son de tal tamaño, que caben en la mano.

Otra ventaja es que las señales GPS (código C/A) están al alcance de

todos, gratuitamente sin necesidad de pagar tasas de licencia ni uso, aunque el

gobierno actual le gustaría cobrar por ello, no es posible pues los satélites

son de EE.UU y de Rusia, con lo cual no tiene ninguna opción de sacar dinero a

costa de este tipo de usuarios. El código denominado P(Y) es de uso militar y

restringido a usuarios autorizados.

8.5.3 GPS en tres pasos básicos

Paso 1

Los satélites son

puntos de referencia. Sus posiciones en el espacio se conocen con toda

precisión, constituyendo la base de todos los cálculos GPS.

Paso 2

El tiempo de viaje de la señal da la

distancia. Mediante una serie de mensajes codificados, un receptor en tierra

determina el momento en que la marca de tiempo partió del satélite, así como el

momento de llegada a su antena. La diferencia es el tiempo de viaje de cada

señal. La distancia es el producto del tiempo por la velocidad de la luz. En

este proceso es donde hay errores.

Paso

3

Tres distancias fijan la posición. Se supone un receptor a

23000 km de un satélite. Esta medición restringe el lugar del universo en que

puede encontrarse el receptor. Indica que ha de estar en algún lugar de una

superficie esférica imaginaria, centrada en ese satélite y con un radio de 23000

km.

Si por ejemplo el receptor se encuentra a 26000 km de un segundo

satélite, eso restringe aún más el lugar, a la intersección entre dos esferas,

que es una circunferencia.

Una tercera medición, añade otra esfera, que

intercepta el círculo determinado por las otras dos. La intersección ocurre en

dos puntos, y así con tres mediciones, el receptor restringe su posición a sólo

dos puntos en todo el universo.

Una cuarta medición seleccionaría uno de

estos dos puntos, pero no es necesario, pues de los dos puntos del paso

anterior, uno está a miles de km de la Tierra, por lo que no tiene sentido.

Aunque a veces es realizada esta cuarta medición, para proporcionar una

forma de asegurar que el reloj del receptor está sincronizado con la hora

universal.

8.5.4 GPS diferencial

Es

una forma de hacer más preciso al GPS. El DGPS proporciona mediciones precisas

hasta un par de metros en aplicaciones móviles, e incluso mejores en sistemas

estacionarios. Esto implica el que sea un sistema universal de medición, capaz

de posicionar cosas en una escala muy precisa.

El DGPS opera mediante la

cancelación de la mayoría de los errores naturales y causados por el hombre, que

se infiltran en las mediciones normales con el GPS.

Las imprecisiones

provienen de diversas fuentes, como los relojes de los satélites, órbitas

imperfectas y, especialmente, del viaje de la señal a través de la atmósfera

terrestre. Dado que son variables es difícil predecir cuales actúan en cada

momento. Lo que se necesita es una forma de corregir los errores reales conforme

se producen.

Aquí es donde entra el segundo receptor, se sitúa en un lugar

cuya posición se conozca exactamente. Calcula su posición a través de los datos

de los satélites y luego compara la respuesta con su posición conocida. La

diferencia es el error de la señal GPS.

No es posible calcular el error

en un momento y que valga para mediciones sucesivas, ya que los receptores de

los satélites cambian continuamente. Para realizar esta tarea es necesario tener

dos receptores operando simultáneamente. El de referencia permanece en su

estación y supervisa continuamente los errores a fin de que el segundo receptor

(el itinerante) pueda aplicar las correcciones a sus mediciones, bien sea en

tiempo real o en algún momento futuro.

El concepto ya está funcionando

algún tiempo y se ha utilizado ampliamente en la ciencia e industria. Hay una

norma internacional para la transmisión y recepción de correcciones, denominada

"Protocolo RTCM SC-104".

8.5.5 ¿ Por qué se necesita

el DGPS ?

Si el mundo fuera como un laboratorio, el GPS sería

mucho más preciso. Dado que el mundo parece una jungla, hay multitud de

oportunidades para que resulte perturbado un sistema basado en la radio. A

continuación se describen los errores a los que hay que enfrentarse:

Errores de los satélites

Los

satélites levan relojes atómicos muy precisos, pero no perfectos. La posición de

los satélites en el espacio es también importante, estos se ubican en órbitas

altas, por lo que están relativamente libres de los efectos perturbadores de la

capa superior de la atmósfera terrestre, pero aún así se desvían ligeramente de

las órbitas predichas.

La atmósfera

La información se transmite por señales de radio y esto constituye otra

fuente de error. La física puede llevarnos a creer que las señales de radio

viajan a la velocidad de la luz, que es constante, pero eso sólo es en el vacío.

Las ondas de radio disminuyen su velocidad en función del medio en que se

propagan. Así pues, conforme una señal GPS pasa a través de las partículas

cargadas de la ionosfera y luego a través del vapor de agua de la troposfera, se

retrasa un poco, lo cual implica un valor erróneo de la distancia del satélite.

Error multisenda

Cuando la

señal GPS llega a la Tierra se puede reflejar en obstrucciones locales antes de

llegar al receptor. La señal llega la antena por múltiples sendas, primero la

antena recibe la señal directa y algo más tarde llegan las desplazadas,

produciendo ruido. Un ejemplo es en el caso de la TV cuando se ven imágenes

múltiples solapadas.

Error del

receptor

Los receptores tampoco son perfectos y pueden

introducir sus propios errores, que surgen de sus relojes o de ruido interno.

Disponibilidad selectiva

Mucho

peor que las fuentes naturales de error es el que aporta intencionadamente el

Departamento de Defensa de EE.UU.. Su finalidad es asegurarse de que ninguna

fuerza hostil utiliza la posición de GPS contra los EE.UU.

Se introduce

ruido en los relojes de los satélites, lo cual reduce su precisión, aunque

también pueden dar datos orbitales erróneos.

Los receptores militares

disponen de una llave física que desencripta los errores introducidos para así

eliminarlos. De esta forma se pueden llegar a precisiones de 15 m.

El

DGPS obtiene mejores precisiones que las conseguidas con las codificadas para

usos militares.

DGPS también proporciona una forma de verificar la

fiabilidad de las mediciones momento a momento.

|

|

|

|

| Relojes de satélites |

1.5 |

0 |

| Errores de órbitas |

2.5 |

|

| Ionosfera |

5 |

0.4 |

| Troposfera |

0.5 |

0.2 |

| Ruido receptor |

0 |

.3 |

| Multisenda |

0 |

.6 |

| Dep. Defensa |

30 |

0 |

|

|

|

|

| Horizontal |

50 |

1.3 |

| Vertical |

78 |

2 |

| 3D |

93 |

2.8 |

8.5.6 ¿ Cómo funciona el DGPS ?

El GPS es "autónomo", esto es, que un solo receptor puede desplazarse a

cualquier sitio y realizar mediciones por sí mismo, empleando como referencia

los satélites GPS. Mientras que el DGPS implica otro receptor añadido, uno que

se desplaza y otro estacionario.

Previamente se han comentado las

diversas fuentes de error. A su vez las distancias entre los dos receptores son

muy pequeñas comparadas con las distancias a las que se encuentran los

satélites, esto quiere decir que recorrerán la atmósfera con retrasos análogos,

de forma que una de las estaciones puede dedicarse a medir esos errores y

facilitárselo a la otra.

Se ha de ubicar el receptor de referencia en un

punto cuya posición se haya determinado con exactitud, al recibir las señales

GPS ataca los cálculos en sentido inverso al de un receptor. Emplea su posición

para calcular el tiempo. Y así obtiene el error entre el teórico y el real.

Todos los receptores de referencia han de facilitar esta información de

errores a todos los receptores itinerantes de su zona con objeto de que corrijan

sus mediciones. El receptor de referencia reconoce todos los satélites visibles

y calcula los errores instantáneos.

Luego codifica esta información en

un formato estándar y lo transmite a los receptores itinerantes.

Algunos

trabajos no requieren correcciones en tiempo real, en este caso se conoce como

GPS posprocesado.

También existe el DGPS invertido, por ejemplo, en una

flota de camiones que informan periódicamente de su posición a una estación

base. En lugar de enviar a los camiones las correcciones diferenciales, la

corrección se realiza en la estación base. Los camiones sólo conocen su posición

de una manera aproximada, pero el controlador sabría la posición exacta, hasta

el punto de poder ubicar el camión en el carril de la calle en que se encuentra.

8.5.7 Aplicaciones de DGPS

Servicio de guardacostas

El

Servicio de Guardacostas de EE.UU. es el responsable de proporcionar todas las

ayudas de navegación. El huracán BOB que azotó la costa este de EE.UU. en 1991

destrozó o desplazó un gran número de boyas. La situación era peligrosa, pues

los barcos iban a puerto confiados en unas boyas que ya no existían o estaban

cambiadas de sitio.

El Servicio de Guardacostas equipó uno de sus barcos

de mantenimiento de boyas con un receptor DGPS y reposicionaron las boyas de

nuevo, en tan solo unos días.

A lo largo de este año se espera esté

implantado el sistema DGPS para toda la costa de EE.UU.

Aviación

Algunos experimentos realizados por la

NASA y por las FAA de EE.UU. contribuyeron al aterrizaje de helicópteros y

aviones de pasajeros mediante DGPS como único sistema guía, sin las radiobalizas

tradicionales.

En la actualidad los sistemas de aterrizaje con poca

visibilidad son tan caros que sólo están disponibles en los mayores aeropuertos.

El DGPS es tan barato que lo puede instalar cualquier aeropuerto. La mejora de

seguridad de vuelo es tremenda.

Como referencia se puede citar Canadá,

donde el sistema GPS ha sustituido al habitual, comnocido como Omega.

Gestión de los recursos naturales

La gestión del uso y protección de los bosques es una gran tarea. Su

estudio topográfico es difícil, sin embargo hay que medir constantemente

parcelas de árboles, ya sea por asunto de su conservación o por ventas a

empresas madereras.

El Servicio Forestal de EE.UU. ha sido uno de los

pioneros del DGPS. Hacen medidas con GPS desde helicópteros.

Otras

aplicaciones son: topografía de galerías de minas, de superficies de pantanos y

de zonas para pesca.

Otro caso es el control de incendios en los

bosques.

Exploración costera

Las empresas petrolíferas gastan enormes cantidades de dinero en la

exploración del fondo de los océanos en busca de lugares idóneos para perforar.

El problema, es que una vez el barco encuentra un lugar de perforación, su

tripulación necesita llevar a ese punto los dispositivos de perforación, lo cual

no es fácil llegar al mismo sitio, al no haber posibilidad de poner marcas de

referencia, y apartarse unos metros significa muchos millones de gasto de más.

Para solucionar este problema usan el GPS.

Otra utilidad es para

mantener a los barcos en las rutas exactas.

También se usan para el

levantamiento topográfico de los puertos.

Gestión

transporte y flotas

Con este sistema el controlador de una

flota puede llevar la cuenta de cada vehículo, el resultado es una más

estricta adhesión al horario y una mejor supervisión.

A las empresas de

transporte, flotas de servicios y servicios de seguridad pública les gusta saber

la posición de sus vehículos incluso al extremo de conocer el nombre de la

calle. La solución es DGPS.

También se usa en los ferrocarriles

El GPS está abriendo una nueva era de "agricultura de

precisión". Un agricultor puede analizar las condiciones del suelo en cada

parcela, y compilar un mapa de las demandas de fertilizante. Este mapa se

digitaliza y se registra en ordenador. La máquina que adiciona los productos

químicos al terreno, va con un GPS y su posición se correlaciona con los datos

previamente digitalizados, añadiendo en cada punto la cantidad exacta de

fertilizante. Se beneficia el agricultor con menos gasto y el medio ambiente

evitando un exceso de productos químicos.

También se puede aplicar a la

fumigación aérea.

Transporte marítimo

En EE.UU. es obligatorio que los barcos petroleros lleven GPS por

motivos de seguridad.

Otras aplicaciones costeras son: la verificación

de vaciados en barcazas, hasta la determinación de las zonas de pesca legal.

Seguridad pública

Para los

servicios de bomberos y policía el tiempo de respuesta es muy importante. Con

DGPS se pueden guiar los vehículos con gran precisión. Los planos de rutas

centralizadas ofrecen a los controladores un mejor conocimiento de la forma en

que están desplegados sus efectivos.

8.5.8 ¿Cómo

solucionar la limitación de los 100 m de resolución?

Como se ha

comentado previamente, el sistema GPS para usos no militares tiene una

limitación puesta intencionadamente por el ministerio de defensa de EE.UU., con

la finalidad, como ya en normal en ellos de incordiar y no beneficiar a nadie,

la limitación a 100 m en la resolución, salvo que se use el DGPS que como se ha

visto requiere más medio y por lo tanto es más costoso. Debido a las presiones

de diversos sectores, el presidente de EE.UU. ha indicado que en el plazo de 10

años se eliminarán las restricciones militares, pero mientras tanto el error en

demasiado grande para algunas aplicaciones, como el control de flotas de

autobuses urbanos. Para resolver esta falta de resolución, en EE.UU se ha

propuesto un sistema aplicable a los autobuses que consta del siguiente

equipamiento en cada autobús, un odómetro o sensor de velocidad del vehículo, y

un giróscopo que nos dará el cambio en acimut del vehículo. Estos sensores ha de

estar perfectamente calibrados y además ha de conocerse ña posición inicial y el

acimut. Como todos los sensores están sujetos a error esta no es la solución

perfecta. La empresa Andrew Corp., ha creado un sistema que combina lo mejor del

GPS y el sistema de posicionamiento continuo (CPS). El sensor de GPS calibra los

sensores para evitar errores acumulados. El factor más importante en la

generación de errores es la estabilidad del giróscopo, reducidos al mínimo con

el sistema Navigator AUTOGIRO, basado en un giróscopo con fibra óptica, diseñado

especialmente para sistemas de navegación. El sistema propuesto por esta empresa

está aplicándose en diversas empresas de transporte urbano de EE.UU.

El

siguiente enlace es una página

dedicada a GPS.![]()

8.6

Seguridad en Redes y Comunicaciones

8.6.1. Introducción

En la

actualidad las comunicaciones y la información, incluyendo voz, imágenes,

textos, números, se crean, almacenan, transfiereen y se accede a ellas mediante

tecnología digital, tal como se ha visto previamente. Desgraciadamente, los

"hackers" (actualmente se estima la existencia de unso 35000 en EE.UU, y se

prevee que aumente esta cifra hasta los 56000 en el año 2000) suelen acceder a

los recursos de las redes y obtener información confidencial. Grandes empresas

están sufriendo pérdidas considerables como resultado del acceso a las redes por

parte de personas no autorizadas.

Los "hackers" pertenecen a

organizaciones bien estructuradas. Estas organizaciones intercambian información

al menos mensualmente y celebran reuniones anualmente. La misma tecnología que

ha revolucionado muchas empresas, también ha revolucionado el crimen

electrónico, usando puntos de entrada no autorizados a la red Internet,

accediendo a comunicaciones a larga distancia. Existen unos 1300 servidores de

información (BBS) ocultos, que tienen información sobre números de tarjetas de

crédito, números de modem e información de teléfonos celulares.

La

seguridad en redes de comunicaciones es una protección contra las pérdidas

debidas al vandalismo y al robo, cuyo origen puede deberse a causas variadas,

como por ejemplo revanchas, retos intelectuales, o planes preconcebidos con

alguna finalidad. Independientemente del motivo, siempre hay un daño a la

víctima.

El robo incluye la copia de documentos confidenciales (tales

como el estado financiero de una empresa) y el uso sin autorización de recursos

como por ejemplo sistemas telefónicos o redes de datos. El vandalismo comprende

la destrucción o corrupción de archivos de datos, introducción de virus

informáticos y reconfiguración de las redes para hacerlas inaccesibles a los

usuarios autorizados.

Las empresas de EE.UU pierden a causa de la

delincuencia informática 550 Millones de dólares al año, una de cada cuatro

empresas ha sido víctima.

Seguidamente se citan algunos casos:

Accedieron a la empresa Boeing Aircraft, tomando todas las

claves de los equipos UNIX.

Las empresas de informática tampoco se ven

libres de esta delincuencia, por ejemplo la empresa SUN, muy conocida por sus

estaciones de trabajo, hace cuatro años se vio forzada a suspender toda su

actividad informática durante 72 horas al descubrirse el acceso de un "hacker" a

su red de 20000 estaciones UNIX, la causa fue que muchos empleados habían puesto

modem en su puesto de trabajo, sin el consentimiento propio de la empresa. SUN

tuvo que cambiar las claves de acceso de sus 20000 equipos.

Usualmente

las grandes empresas y organismos oficiales protegen los puntos de acceso a sus

instalaciones, vigilantes de empresas de seguridad son habituales en las

entradas, normalmente cualquier persona que acceda ha de estar completamente

identificada y en algunos casos sólo puede desplazarse a algunas partes del

edificio. De forma análoga en las redes de comunicaciones hay sistemas de

seguridad respecto a los accesos y diversas posibilidadades para llegar hasta

distintas informaciones en función del tipo de usuario que se sea.

Hay

tres formas principales de atacar la seguridad de un ordenador:

A) Ataques pasivos

La

obtención fraudulenta de los datos puede tener lugar en cualquier punto del

enlace de comunicaciones o de la red.

Cualquiera que sea el medio

utilizado para transmitir los datos, se podrá averiguar con distintos grados de

dificultad. Las líneas telefónicas pueden disponer de conexiones eléctricas

directas realizadas en cualquier punto poco vigilado. Los procedimientos de

escucha no invasivos, como los que utilizan acoplamiento inductivo, sólo son

adecuados para ataques pasivos. Los equipos de control se pueden conectar a las

líneas telefónicas dentro de los edificios que contienen el ordenador o

cualquier o en cualquier punto a lo largo del enlace. Los datos pueden grabarse

localmente o transmitirse a un receptor/grabador cercano, fuera del edificio. Si

se emplea un transmisor se alimentará de la tensión contínua de la red

telefónica pública, aunque esto puede originar una baja impedancia en la línea,

y por lo tanto ser detectado. Si se conecta un sistema de elevada impedancia, es

imposible de detectar.

Los enlaces por microondas y satélite se pueden

interceptar mediante receptores de radio de alta sensibilidad. Los lóbulos

laterales de las antenas de microondas permiten monitorizar las señales en las

proximidades de las torres repetidoras, sin estar en la ruta directa del haz

principal. Los enlaces por satélite son accesibles en una zona bastante amplia

alrededor de la estación receptora de tierra. También son posibles los ataques

activos a enlaces de datos via satéite y microondas, pero son fáciles de

detectar.

El cable coaxial de alta calidad y correctamente instalado

emite una cantidad despreciable de energía electromagnética, pero si el cable se

dobla más de lo que permite su radio de curvatura máximo, se incrementan las

fugas. UN equipo de radio sería capaz de intervenir de forma no invasiva en el

enlace.

Cualquier equipo electrónico para transmisión de datos puede

radiar emisión electromagnética a partir de la cual se pueden obtener los datos.

Un receptor sensible localizado cerca del equipo o conectado a sus líneas de

alimentación o a otros conductores cercanos se puede utilizar para filtrar y

grabar las emisiones. Los teléfonos sirven de receptores excelentes para la

radiación de campo cercano procedente de un ordenador. El bucle de abonado se

puede evitar colocando un díodo zener entre los contactos y las señales

recogidas se pueden monitorizar interviniendo la línea telefónica fuera de la

zona de seguridad.

B) Ataques activos

Estos ataques se pueden dividir en tres categorías:

1.

Modificación de mensajes

2. Negación de servicio de mensajes

3.

Iniciación de asociación espúrea

8.6.2 Claves De Acceso

Para

garantizar la seguridad se utilizan las palabras claves de acceso "password" o

PIN muy conocidos por ejemplo para el acceso a terminales bancarias.

Desdichadamente este sistema no proporciona una seguridad absoluta, pues son

fáciles de robar, copiar y usar fraudulentamente.

Las palabras claves

("password") han de ser secretas para el resto de los usuarios, por lo que la

persona que la tiene es lógico que siga los consejos indicados seguidamente:

En el año 1993 un 20 % de los accesos fraudulentos se debían

al uso de diccionarios para buscar la palabra clave. Un 86% de códigos de

acceso estaban dentro de uno de estos conjuntos, palabras en un diccionario,

palabras de un diccionario pero al revés, nombres comunes, números de

matrículas del coche y otros números como el del DNI.

8.6.3 Encripción

En la

primera guerra mundial surgió la necesidad de proteger los mensajes que se

enviaban entre teletipos. Gilvert S. Vernam desarrolló en 1917 un sistema de

cifrado adecuado utilizando una clave secreta que se combinaba con los

caracteres del texto original, utilizando una función exclusiva, para formar

los caracteres cifrados que se transmitían. En el receptor se recuperaba el

texto original mediante un proceso análogo.

La encripción o cifrado es

un proceso que transforma texto legible por cualquiera. en una forma

incomprensible conocida como texto cifrado, mediante el uso de algoritmos

matemáticos. Sólo los usuarios con una clave digital. un programa codificador

y decodificador basado en el algoritmo correspondiente, pueden leer el

mensaje.

Existen dos métodos básicos de cifrado:

Este procedimiento usa una clave única para encriptar y

desencriptar los datos. La clave debe ser poseída tanto por el emisor de los

datos como por el receptor. Este sistema es válido para enviar información

desde un punto a un conjunto, o para transferirla entre dos puntos, siempre

ques ea en poca cantidad.

Hay un estándar para este sistema, conocido

como DES (Data Encryption Standar). DES es un esquema adoptado y mantenido por

el Instituto para las Ciencias de la Computación y Tecnología, en el National

Bureau of Standars (EE.UU.). DES especifica un algoritmo para encriptar y

desencriptar información digital, basado en una clave binaria. La clave consta

de 64 bit, 56 se usan en la operación correspondiente y los 8 restantes se

emplean para corrección de errores. La clave se genera de forma que los 56 bit

son aleatorios. Al ser cada clave única, los resultados después de aplicar el

algoritmo son únicos. Con este sistema hay 72*1015 combinaciones

posibles.

Este sistema es habitual en la comunidad financiera y en

industrias que necesitan elevados niveles de seguridad.

B) Clave de encripción pública. (o asimétrico)

Este sistema usa pares de claves, una privada y otra pública. La

privada se emplea en el ámbito personal y no se distribuye, mientras que la

otra, la pública, se difunde al ser necesaria para decodificar los mensajes.

Cada clave pública sólo decodifica los mensajes emitidos por el propietario de

la clave correspondiente privada.

Hay un esquema ampliamente

difundido, RSA, que se distribuye gratuitamente para fines no comerciales,

aunque hay que pagar si se usa con fines comerciales, a la empresa que lo ha

creado ( RSA Security Inc.).

Se

emplea frecuentemente en sistemas de correo electrónico, para proteger los

mensajes privados a través de redes de comunicación.

Una nueva

solución de encripción es el "chip" Clipper,

desarrollado por la "National Security Agency", para proteger la información

digital a través de las redes telefónicas públicas. Sin embargo este sistema

ha suscitado muchas controversias desde

su creación;

es como si todos los ciudadanos tuviéramos que depositar una llave de la

puerta de nustra vivienda, y que en cualquier momento pudiera hacer uso de

ella la policía, queda claro que esto es inaceptable, y va contra los derechos

fundamentales de cualquier persona.

Además otro problema es que el

punto de acceso para permitir su control a algunas agencias gubernamentales,

como el FBI, puede dar lugar al acceso de "hackers"

C) AES

(AES

- Advanced Encryption Standard, Estándar de Cifrado Avanzado)

AES es

el Estándar de cifrado Avanzado, el algoritmo de cifrado que debe reemplazar a

DES. En 1997 el gobierno de los Estados Unidos (NIST realmente), solicitó

algoritmos candidatos para convertirse en este estándar. En Junio de 1998 (la

fecha límite de envío), NIST había recibido quince propuestas. NIST solicitó

comentarios acerca de estos algoritmos, con el objetivo de reducir la lista a

cinco finalistas. NIST convocó una conferencia en Roma en Abril (esta era la

segunda conferencia AES, la primera tuvo lugar en Agosto anterior en

California), la fecha límite para los comentarios era Junio y recientemente el

NIST dio a conocer los finalistas.

Son los siguientes:

Mars,

presentado por un amplio equipo de IBM.

RC6, de RSA Data

Security(incluyendo a Ron Rivest)

Rijndael, de un equipo de excelentes

ciptógrafos belgas.

Serpent, de tres criptógrafos muy respetados; Ross

Anderson, Eli Biham y Lars Knudsen

TwoFish, de Counterpane

Systems

NIST no solo anunció los cinco finalistas. Publicaron un

informe de 52 páginas en el que explican sus razonamientos -- por qué

seleccionaron los algoritmos elegidos y por qué no seleccionaron los no

elegidos -- y vale la pena leerlo para asomarse a su proceso de

decisión.

El siguiente paso es elegir entre los finalistas. NIST

solicita de nuevo comentarios sobre estos algoritmos, y ha habido una tercera

Conferencia de Candidatos AES en New York en Abril del 2000, convocada

conjuntamente con el 7º encuentro de trabajo de Software Rápido de cifrado. El

AES entonces pasará al proceso de aprobación de estándares del gobierno y se

convertirá en un Estándar Federal de Procesamiento de Información (FIPS,

Federal Information Processing Standard), y presumiblemente se convertirá en

el algoritmo estándar de cifrado para todo tipo de aplicaciones

internacionales. Se espera que todo esto suceda para el verano del 2001; el

gobierno se mueve lentamente.

Los criptógrafos están muy ocupados

analizando la seguridad. Podemos pensar en el proceso como si se tratara de un

gran derby de demolición: todo el mundo envía sus algoritmos y entonces se

dedica a atacar los de los otros... el último que resista gana. Realmente, no

será tal y como lo hemos descrito.

Cuando finalice el periodo de

análisis, no es de esperar que se encuentren debilidades importantes en

ninguno de los finalistas. La elección del ganador se basará en otros

factores: rendimiento, flexibilidad, idoneidad.

AES tendrá que

trabajar en una variedad de aplicaciones presentes y futuras, realizando todo

tipo de diferentes tareas de cifrado: microprocesadores de 32 bits,

microprocesadores de 64 bits, pequeñas tarjetas inteligentes de 8 bits, DSPs,

FPGAs, ASICs a medida y cualquier otra cosa que aún no podamos

imaginar.

Seleccionar un solo algoritmo para todas estas aplicaciones

no es fácil. Podría tener más sentido tener una familia de algoritmos, cada

uno optimizado para una aplicación particular, pero habrá sólo un AES. Y

cuando AES se convierta en un estándar, los clientes querrán que sus productos

de cifrado cumplan "el estándar de moda". Los solicitarán en el hardware, en

los ordenadores de sobremesa, en las tarjetas inteligentes, en terminales de

comercio electrónico y en otros sitios en los que jamás se hubiera pensado que

podrían ser usados. Cualquier cosa que elijamos para AES deberá trabajar en