|

Technische Universität Dresden

Fakultät Wirtschaftswissenschaften

Lehrstuhl Wirtschaftsinformatik,

insbesondere Systementwicklung

User Interface für ein generisches

Modellierungswerkzeug

Diplomarbeit

zur Erlangung des akademischen Grades

"Diplom-Wirtschaftsinformatiker"

Bearbeiter: Yves Köth

Matrikelnummer: 2417018

Betreuer: Prof. Dr. Werner Esswein

Steffen Greifenberg

Bearbeitungszeit: 01.10.2000 – 30.04.2001

Abstract

Bei sehr vielen Softwareprojekten ist die Entwicklung einer anspruchsvollen Benutzungsschnittstelle unverzichtbar (vgl. [VoNe98] S. 1). Dies liegt vor allem an den mit den technischen Möglichkeiten gestiegenen Erwartungen von Benutzern. Ein Softwareprodukt wird nicht nur an seiner Funktionalität sondern auch an seiner Benutzungsschnittstelle (engl. User Interface) bewertet. Umfangreiche Studien haben zu Tage gebracht, dass sich gutes User Interface Design kostensenkend bei der Nutzung des Produkts auswirkt. Auch in der Entwicklungsphase kann sich ein durchdachtes Design positiv auswirken, da Anpassungen bzw. Änderungen in späten Projektphasen zeitaufwendig und kostensteigernd sind.

Die Beurteilung von Oberflächen wird durch den Benutzer selbst durchgeführt. Damit übernimmt er eine zentrale Rolle beim Entwurf von Benutzungsschnittstellen. Aus diesem Grund beschäftigt sich der erste Teil der Diplomarbeit mit den psychologischen Aspekten der menschlichen Informationsverarbeitung. Darauf aufbauend befasst sich der Hauptabschnitt mit dem Entwurf von Oberflächen. Dabei wird der von der ISO geforderte benutzerorientierte Gestaltungsprozess eingehend erläutert. Es wird herausgearbeitet, welche Kriterien die Benutzbarkeit von Software sowohl positiv als auch negativ beeinflussen. Daraus werden Forderungen für die Gestaltung von Oberflächen abgeleitet. Anschließend werden Entwurfstechniken diskutiert, die den Entwickler bei der Umsetzung der Anforderungen unterstützen können. Diese sehr allgemein formulierten Empfehlungen werden in einem Style Guide konkretisiert.

Der letzte Teil der Diplomarbeit beschäftigt sich mit der Evaluierung von Benutzungsschnittstellen. In diesem Rahmen wird auch der Prototyp für das generische Modellierungswerkzeug GME 2001 beschrieben. Für seine Entwicklung werden Use case Diagramme und Klassendiagramme ausgearbeitet. Ihre Umsetzung erfolgt mit Hilfe der Entwicklungsumgebung JBuilder 4.0 Foundation. Um die Auswahl eines geeignetes Tools zu ermöglichen, wird im Vorfeld eine Analyse von vier verbreiteten Entwicklungsumgebungen durchgeführt.

In der abschließenden Zusammenfassung wird die Arbeit kritisch gewürdigt, sowie ein Ausblick auf zukünftige Trends und Entwicklungen im Bereich der Benutzungsschnittstellen gegeben.

Inhaltsverzeichnis

0 Einleitung *

1 Ziele der Softwareergonomie *

2 Psychologische Aspekte der MCI *

2.1 Informationsaufnahme des Menschen *

2.1.1 Informationsverarbeitung *

2.1.2 Die psychologischen Gestaltgesetze *

2.2 Mentale Modelle *

2.3 Metaphern *

3 Design ergonomischer Oberflächen *

3.1 Usability Design *

3.2 Aufgaben und Benutzeranalyse *

3.2.1 Aufgabenanalyse *

3.2.2 Benutzeranalyse *

3.3 Gestaltungsgrundsätze für Dialoge *

3.3.1 Aufgabenangemessenheit *

3.3.2 Selbstbeschreibungsfähigkeit *

3.3.3 Steuerbarkeit *

3.3.4 Erwartungskonformität *

3.3.5 Fehlertoleranz *

3.3.6 Individualisierbarkeit *

3.3.7 Lernförderlichkeit *

3.4 Entwurfstechniken *

3.4.1 Fenstersysteme *

3.4.2 Interaktionsformen *

3.4.2.1 Deskriptive Interaktion *

3.4.2.2 Menüs *

3.4.2.3 Direkte Manipulation *

3.4.3 Antwortverhalten *

3.4.4 Icons *

3.4.5 WYSIWYG-Prinzip *

3.4.6 Hilfesystem *

3.4.7 Fehlerbehandlung *

3.4.8 Individualisierung *

4 Style Guide *

4.1 Entwicklung des Style Guide *

4.2 Beschreibung der visuellen Klassen *

4.2.1 GMEJFrame *

4.2.2 JPanel *

4.2.3 JScrollPane *

4.2.4 JTabbedPane *

4.2.5 JSplitPane *

4.2.6 JToolBar *

4.2.7 Border *

4.2.8 GMEBorder *

4.2.9 Nutzung von Layoutmanagern *

4.2.10 JMenu, JPopupMenu *

4.2.11 JLabel *

4.2.12 JButton *

4.2.13 JTextField *

4.2.14 JDateField *

4.2.15 JTextArea, JEditorPane *

4.2.16 JTextPane *

4.2.17 JCombobox *

4.2.18 JList *

4.2.19 JTree *

4.2.20 JTable *

4.2.21 JCheckBox *

4.2.22 JRadioButton *

4.2.23 Tooltips *

4.3 Icons *

5 Evaluation ergonomischer Oberflächen *

5.1 Prototyping *

5.1.1 Horizontaler Prototyp *

5.1.2 Vertikaler Prototyp *

5.1.3 Szenario *

5.1.4 Entwicklung des Prototypen *

5.2 Werkzeuge *

5.2.1 VisualAge for Java, Entry Edition 3.0 *

5.2.2 Forte for Java, Community Edition 1.0 *

5.2.3 VisualCafé 4.0 Standard Edition *

5.2.4 JBuilder 4.0 Foundation *

5.3 Entwicklung des Prototypen GME 2001 *

5.3.1 Beschreibung des E3-Ansatz *

5.3.2 Ziele des Prototypen *

5.3.3 Spezifikation des Prototypen *

5.3.3.1 Workspace *

5.3.3.2 Typeneditor *

6 Zusammenfassung und Ausblick *

Abbildungsverzeichnis *

Abkürzungsverzeichnis *

Literaturverzeichnis *

Anhang *

A Ergänzende Abbildungen *

A.1 Vergleich der Entwicklungsumgebungen anhand einer Checkliste *

A.2 Das E3-Modell *

A.3 Mehrstufige Sichtenbildung im E3-Modell *

A.4 Abbildung des Workspace *

A.5 Wizards im Prototyp *

A.5.1 Unterstützung beim Anlegen eines neuen Schemas *

A.5.2 Unterstützung beim Anlegen eines neuen Projektes *

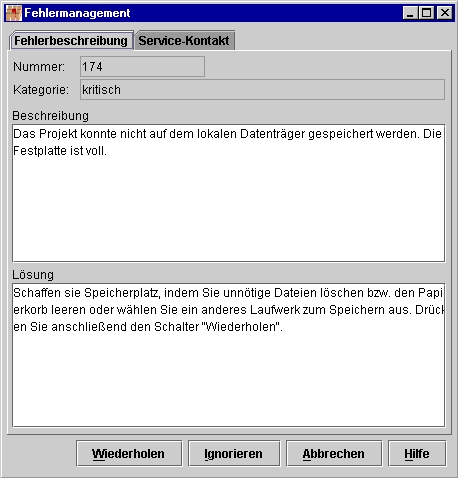

A.6 Fehlersystem im Prototyp *

A.7 Hilfesystem im Prototyp *

A.8 Design von Benutzungsschnittstellen *

A.9 Gesamtprozeß der Piktogrammentwicklung *

A.10 Evaluierungsprozeß von Software *

A.11 Rating Level *

A.12 Qualitätsmodell für Benutzungsschnittstellen (grob) *

B Checklisten *

B.1 Evaluierung von Fenstern *

B.1.1 Überprüfung von Struktur und Layout des GMEJFrame *

B.1.2 Überprüfung von Panelen (inkl. JScrollPane und JTabbedPane) *

B.1.3 Überprüfung sonstiger Bildschirmelemente *

B.1.4 Verhalten von Bildschirmelementen *

C Spezifikation des Prototyp *

C.1 Statische Sicht *

C.1.1 Use Case Diagramme des Prototyp GME 2001 *

C.1.2 Klassendiagramme des GME Prototyp *

C.1.3 Klassendiagramm einzelner Interaktionselemente *

C.2 Dynamische Sicht *

C.3 Detaillierte Beschreibung ausgewählter Klassen *

C.3.1 Spezifikation der Klasse Project *

C.3.2 Spezifikation der Klasse Task *

C.3.3 Spezifikation der Klasse Model *

C.3.4 Spezifikation der Klasse ChangeDescription *

C.3.5 Alle bisher definierten Randtypen *

0

Einleitung

Das Thema Softwareergonomie hat in den letzten Jahren deutlich an Bedeutung gewonnen. Seit nunmehr fast 20 Jahren wird in Deutschland auf diesem Gebiet der Wissenschaft intensiv geforscht. Im Jahr 1993 wurde eine EG-Richtlinie veröffentlicht, die bei der Einführung von Arbeitsplatzsystemen fordert, dass das Wissen über Softwareergonomie bei der Entwicklung von Anwendungssystemen zu nutzen ist. Seither hat sich diese vergleichsweise junge Wissenschaft rasant weiterentwickelt.

Nach Anfangs wagen Definitionen von Softwareergonomie bildeten sich, abhängig von dem Interesse und der Sichtweise des Verfassers, verschiedene Ansätze heraus. Auch heute ist eine eindeutige Definition nicht möglich. Eberle definiert Softwareergonomie als disziplinübergreifende Wissenschaft, die sich "speziell mit der benutzergerechten Gestaltung der Mensch-Computer-Interaktion" beschäftigt ([Eber94] S. 1) . Wie in der Definition mit dem Begriff "disziplinübergreifend" angedeutet, werden in der Softwareergonomie Teile der Disziplinen Psychologie, Organisation, Design, Statistik und Informatik genutzt. Treu definiert erweiternd Interaktion als die gegenseitige Beeinflussung von mindestens zwei Partnern (vgl. [Treu94] S. 23). Der Begriff umfasst damit nicht nur die eigentliche Kommunikation, sondern auch alle anderen Einflüsse. Dazu gehört beispielsweise die Erzeugung von Stress oder Zufriedenheit. Unter Mensch-Computer-Interaktion (MCI) wird darauf aufbauend die zweckorientierte Kombination von physischen, logischen, begrifflichen und sprach-basierten Aktionen zwischen Benutzer und Computer verstanden. Wie Eberle bereits beschrieben hat, sollte die MCI benutzergerecht gestaltet sein. Damit wird der Fokus auf den Benutzer gesetzt. Ein Benutzer ist ein Individuum, welches eine Anwendungssystem nutzt. Im folgenden wird er auch als Anwender bezeichnet. Unter benutzergerechter Gestaltung wird der Entwurf von Softwaresystemen mit dem Wissen über kognitive Fähigkeiten und Beschränkungen des Benutzers beschrieben. Das Ziel besteht darin, die Produktivität zu erhöhen und eine sichere, komfortable und befriedigende Benutzung zu ermöglichen.

Um eine Interaktion zwischen Mensch und Computer überhaupt zu ermöglichen wird eine Schnittstelle benötigt. Als Benutzungsschnittstelle wird die gesamte Kommunikationsschnittstelle zwischen Mensch und Rechner bezeichnet (vgl. [VoNe98] S. 2). Zu ihr gehören Input-Output Geräte wie Bildschirm, Tastatur und Maus, genau so wie das Systemverhalten der Software oder die Dokumentation. Mit der Benutzungsoberfläche (kurz: Oberfläche) wird in der folgenden Arbeit nur die Darstellung und das Verhalten der Software gemeint. Sie definiert den nach außen sichtbaren Anteil der Benutzungsschnittstelle. Auf die physikalischen Aspekte der Benutzungsschnittstelle wird hier nicht eingegangen. Die Darstellung der Benutzungsoberfläche gibt dem Benutzer die Möglichkeit, einen Ausschnitt des Systems zu sehen. Das Verhalten der Oberfläche ermöglicht eine Veränderung sowohl des Systems selbst, als auch der Sicht auf das System. Dieser Aspekt wird durch einen Benutzungsschnittstellenprogrammierer umgesetzt. Im Gegensatz dazu wird das Aussehen der Benutzungsoberfläche durch einen Benutzungsoberflächendesigner gestaltet. Dieser entwickelt unter Mithilfe der zukünftigen Benutzer Layout und Dialogverhalten des Anwendungssystems nach softwareergonomischen Kriterien. Die folgende Arbeit richtet sich vor allem an den zuletzt genannten Personenkreis.

In den kommenden Ausführungen werden die folgenden allgemeinen Formatkonventionen benutzt. Auf davon vorkommende Abweichungen wird explizit im Text hingewiesen.

Definition kennzeichnet den im Satz definierten Begriff

Hervorhebung stellt eine besondere Bedeutung des Begriffes dar

Klasse bezeichnet eine Klasse

Attribut bezeichnet ein Attribut einer Klasse

Operation bezeichnet eine Operation einer Klasse

1 Ziele der Softwareergonomie

Das Ziel eines Softwaresystems ist die optimale Unterstützung des Benutzers bei der Aufgabenerfüllung. Die Benutzungsschnittstelle, als Bestandteil der Software muss eine effiziente und effektive Kommunikation zwischen Anwender und dem funktionalem Kern des Anwendungssystem gewährleisten. Die Effizienz gibt den im Verhältnis zur Genauigkeit und Vollständigkeit eingesetzten Aufwand an, mit dem Benutzer ein bestimmtes Ziel erreichen (vgl. [ISO9241-11] S. 4). Die Effektivität gibt die Genauigkeit und Vollständigkeit an, mit der Benutzer ein bestimmtes Ziel erreichen.

Shneiderman nennt fünf zentrale Kriterien für den Entwurf von Benutzungsschnittstellen: Erlernbarkeit, Geschwindigkeit der Aufgabenerledigung, Fehlerrate, Erinnerungsrate und subjektive Zufriedenheit des Benutzers (vgl. [Shne98] S. 15). Nielsen tauscht in seiner Aufzählung lediglich die Geschwindigkeit der Aufgabenerledigung mit dem Begriff Effizienz, meint aber prinzipiell das Gleiche (vgl. [Niel93] S. 26ff). Die einzelnen Kriterien beeinflussen sich gegenseitig, so dass für ihre Ausprägung immer ein Kompromiss gefunden werden muss. Die genannten Aspekte werden unter dem Begriff Usability (deutsch: Benutzbarkeit) zusammengefasst und können zur Evaluation von Software verwendet werden.

Die Nutzung der Schnittstelle darf nicht selbst zur Aufgabe bzw. zu einem Problem werden, sondern sollte so transparent wie möglich ablaufen. Damit kann ergonomische Software in einem Unternehmen zu erheblichen Kostensenkungen führen. In diesem Bereich wurden umfangreiche Studien durchgeführt. Das Hauptproblem bei diesen ist die Messung und Zuordnung der genauen Kostensenkungen oder -erhöhungen. Nielsen beschreibt in seinen Buch einige Beispiele (vgl. [Niel93] S. 2ff). So sparte ein australisches Versicherungsunternehmen ca. A$500.000 durch das Neudesign der Bildschirmformulare in einer Anwendung. Die Kosten des Projekts betrugen A$100.000. Durch das neue Design wurde die Fehlerrate deutlich gesenkt und damit Kosten eingespart. In vielen dieser Beispiele, die Nielsen in seinem Buch beschreibt, werden Kosten durch Zeiteinsparung gesenkt. Ein Benutzer kann an vielen verschiedenen Stellen im Anwendungssystem Zeit sparen. So können bereits mit sinnvollen Vorgaben in Eingabefeldern erhebliche Steigerungen der Arbeitsgeschwindigkeit erzielt werden. Da viel Zeit bei der Korrektur von Fehlern verloren geht, sollten Fehlerquellen durch entsprechendes Design vermieden werden. So wurde in einem anderen Versicherungsunternehmen das eingesetzte System durch die Anwender bewertet und 130 Benutzungsprobleme festgestellt. Es ist offensichtlich, dass der Entwicklungsprozess nicht unter Mithilfe der Benutzer vonstatten ging bzw. die Evaluation schlecht durchgeführt wurde. Viele der genannten Probleme hätten sich einfach vermeiden lassen, wären sie bekannt gewesen.

Diese Studie ist kein Einzelfall. Nach einer Einschätzung des TÜV Rheinland sind 60 Prozent der Anwender mit ihrem Computerprogramm unzufrieden. Durch Handhabungsprobleme gehen 20 Prozent der Terminal-Arbeitszeit verloren (vgl. Burm+00] S. 54), was einen enormen wirtschaftlichen Verlust darstellt. Diese Benutzungsprobleme führen nicht nur zu einem schleichenden Imageverlust und hohen Kosten der Hotline des Herstellers, es treten auch andere Schwierigkeiten auf. So ist vor allem bei der Einführung eines neuen Systems mit erheblichen Widerstand der betroffenen Personen zu rechnen. Wird dieser durch das Auftreten ergonomischer Schwächen verstärkt, kann das ein Scheitern des gesamten Projektes zur Folge haben. Das Ergebnis ist ein Anwendungssystem, dass niemand nutzt. Die Akzeptanz von Systemen steigt automatisch mit dem Grad Ihrer Ergonomie.

Während man in der Vergangenheit ca. 20 Prozent der Entwicklungszeit eines Softwaresystem für die Benutzerschnittstelle zuordnete, muss man heute mit einer inversen Verteilung rechnen (vgl. [ReMo95] S. xi). D.h., dass bis zu 80 Prozent der Entwicklungszeit für die Gestaltung der grafischen Benutzungsschnittstelle (BS) benötigt werden. Es gibt eine Vielzahl von Gründen für diese Entwicklung (vgl. [Prei99] S. 1f). Zum einen ist aufgrund der technischen Entwicklung eine grafische Oberfläche für fast jedes System realisierbar. Zum anderen haben sich die Aufgabenbereiche und damit die Benutzer geändert. Wurden früher Computersysteme ausschließlich von Experten genutzt, stehen sie heute einem breiten Benutzerkreis zur Verfügung. Die neuen Aufgabenbereiche erfordern größtenteils die im Gegensatz zur asynchronen (Batch-)Arbeitsweise stehende interaktive Kommunikation mit dem Anwendungssystem. Um am Markt bestehen zu können, muss das Softwaresystem mit einer angemessenen grafischen BS ausgestattet sein. Im Ergebnis daraus werden diese immer umfangreicher und komfortabler. Das bedeutet gleichzeitig, dass ein großer Anteil der Projektkosten in diesem Bereich der Softwareentwicklung eingesetzt werden muss. Beschleunigt man die Entwicklung der grafischen BS so sinken die Gesamtkosten des Projektes. Eine Beschleunigung kann durch verschiedenste Maßnahmen erreicht werden. Einer der wichtigsten Punkte besteht darin, nachträgliche Korrekturen zu minimieren. Wird von Anfang an auf ergonomische Aspekte geachtet, so müssen diese nicht nachträglich eingebracht werden.

Akzeptanz beim Kunden und Entwicklungskosten der Software haben entscheidenden Einfluss auf den Markterfolg eines Anwendungssystems. Es ist der Trend zu beobachten, dass Kunden vermehrt auf eine ergonomische Benutzungsschnittstelle achten. Dies liegt auch an der seit 1.1.2000 gültigen Bildschirmarbeitsverordnung, die in ihrem Anhang (Nr. 20-22) Grundsätze der Softwareergonomie darlegt (vgl. [GEAE97]). Mit Einführung europäischer Normen wie beispielsweise der ISO 9241 wurden dem Kunden auch entsprechende Werkzeuge für die Bewertung von Software zur Verfügung gestellt. In Zeiten des Outsourcing und der Profitcenter, wo kaum noch Softwareprojekte unabhängig vom Wettbewerb entwickelt werden können, gewinnen diese Aspekte immer mehr an Bedeutung.

2 Psychologische Aspekte der MCI

2.1 Informationsaufnahme des Menschen

Eine notwendige Grundlage für Oberflächenentwickler ist das Verständnis für die kognitiven Fähigkeiten des Benutzers (vgl. [Shne98] S. 20). Diese sind die Voraussetzung des Anwenders, um die vom Anwendungssystem angebotenen Informationen aufzunehmen und zu verarbeiten.

2.1.1 Informationsverarbeitung

Seit den sechziger Jahren wird in der Psychologie versucht, Verhalten und Erleben des Menschen als Informationsverarbeitung zu betrachten (vgl. [Glas94] S. 7ff). Dies wird durch die Nutzung der Computermetapher ermöglicht. Die Hardware findet ihre Analogie im physischen Organismus, dem Untersuchungsgebiet der Biologie und Physiologie, die Software entspricht dem geistigen Geschehen im Menschen, dem Gebiet der Psychologie. Die psychologische Grundlagenforschung geschieht heute überwiegend im Rahmen dieses Informationsverarbeitungsansatzes.

Auf dieser Basis wurde das Modell der Architektur der menschlichen Kognition entwickelt (vgl. Abbildung 1). In diesem steht das Individuum der Umwelt gegenüber. Die informationellen Einwirkungen der Umwelt auf den Menschen werden unter dem Begriff Wahrnehmung subsumiert. Sie stellen den Input für den Benutzer, d.h. gleichzeitig den Output eines Softwaresystems dar. Dieser Bereich ist vor allem für die Gestaltung der Benutzungsschnittstelle von Bedeutung (vgl. Abschnitt 2.1.2). Die Verarbeitung der Informationen im Exekutivsystem wird mit Hilfe des Gedächtnissystems realisiert. Dieses arbeitet unter Nutzung von mentalen Modellen. Sie sind für die Struktur einer Benutzungsschnittstelle von entscheidender Bedeutung (vgl. Abschnitt 2.2). Das Gedächtnissystem greift auf das Kurz- und Langzeitgedächtnis zurück. In verschiedenen Arbeiten wurde versucht, dass Gedächtnissystem zu quantifizieren, um direkte Aussagen über die Fähigkeiten von Benutzern treffen zu können. Damit lässt sich für verschiedene Aufgaben berechnen, wie lange der Benutzer für Ihre Erfüllung braucht und in welchem Maße das Gedächtnissystem belastet wird. Auf eine intensivere Behandlung dieses Themas wird an dieser Stelle verzichtet. Zusammenfassend lässt sich feststellen, dass das Kurzzeitgedächtnis äußerst begrenzt ist. Müssen Informationen länger gemerkt werden, muss das Gedächtnissystem dies aktiv unterstützen. Diese aktive Unterstützung, die mittels des Exekutivsystems realisiert wird, ist jedoch so aufwendig, dass anderweitige Aufgaben nur sehr begrenzt erfüllt werden können.

Abbildung 1 Architektur der menschlichen Kognition (vgl. [Glas94] S. 10)

Für die Softwareergonomie bedeutet das, möglichst immer alle relevanten Informationen bereit zustellen, so dass der Benutzer sein Kurzzeitgedächtnis wenig belasten muss.

2.1.2 Die psychologischen Gestaltgesetze

Der Bildschirm ist zur Zeit die wichtigste Informationsquelle bei der MCI. Das bedeutet, dass die meisten Informationen für den Benutzer visuell wahrgenommen werden. Aus diesem Grund wird im folgenden Abschnitt vor allem auf die Gestaltgesetze eingegangen, obwohl sie nur einen kleinen Teil der Wahrnehmungstheorie darstellen.

Die Gestaltgesetze sind Phänomene der visuellen Wahrnehmung, die in umfangreichen Untersuchungen herausgearbeitet wurden. Sie basieren auf der Tatsache, dass der Mensch bei der Aufnahme von visuellen Informationen das Wahrnehmungsfeld in Figur und Grund zerlegt. Alles was als Figur identifiziert wird, entspricht einem wahrgenommenen Objekt, der Grund bleibt unbeachtet. Die Frage, was als eine Figur erkannt wird sollen die Gestaltgesetze beantworten (vgl. [Glas94] S. 25ff).

Das Gesetz der Nähe als eines der bekanntesten Gestaltgesetze besagt, dass Elemente mit enger räumlicher Nähe als zusammengehörend wahrgenommen und damit als ein Objekt bzw. eine Figur erkannt werden. Ordnet man eine zweidimensionale Matrix von Punkten so an, dass der Abstand in der horizontalen Richtung größer ist als in der vertikalen, so entsteht ein Bild von mehreren Spalten. Das Gesetz der Gleichheit bzw. Ähnlichkeit besagt, dass ähnliche oder gleich aussehende Elemente schneller zum Zusammenschluss anregen als unterschiedliche Elemente. Wählt man im vorigen Beispiel gleiche Abstände zwischen den Elementen und ändert die Farbe in vertikaler Richtung, so entsteht bei der Wahrnehmung der Eindruck von Zeilen. Das Gesetz der guten Fortsetzung besagt, dass sich schneidende Konturen so interpretiert werden, dass beteiligte Linien wenn möglich nicht als geknickt erscheinen. Bei dem Gesetz der Schließung bzw. Geschlossenheit wird ausgesagt, dass nahezu geschlossene Konturen als eine Figur wahrgenommen werden, wobei das Innere die Figur und das Äußere der Grund wird. Dabei werden nicht existierende Teile einer Figur hinzugefügt. Dies gilt für alle Objektgruppen, die räumlich getrennt sind und bei denen der Betrachter eine kohärente Figur zu erkennen versucht (vgl. [ISO9241-12] S. 10). Die folgende Abbildung illustriert die beschriebenen Gesetze.

Abbildung 2 Die wichtigsten Gestaltgesetze

Die Gestaltgesetze werden oft in Kombination angewandt. Dabei folgt der Mensch dem Minimalprinzip, indem für die analytisch-geometrische Beschreibung des Wahrnehmungsfeldes so wenig wie möglich Informationen benötigt werden.

Zusammenfassend lässt sich sagen, dass der Mensch außergewöhnliche Fähigkeiten im Bereich der Wahrnehmung besitzt. Er kann beispielsweise Oberflächen bereits mit kleinsten Hinweisen wahrnehmen. Im Beispiel in Abbildung 3 glaubt man, ein Dreieck über drei Kreisen zu sehen. Sogar die Seiten des Dreiecks über dem weißen Papier scheinen sichtbar.

Abbildung 3 Beispiel für subjektive Konturen

Diese Fähigkeit hilft auch bei der Wahrnehmung dreidimensionaler Elemente. Auf den Gestaltgesetzen lässt sich keine geschlossene Theorie aufbauen, die den Aufbau des Bildschirminhalts beschreibt. Einige Hinweise lassen sich dennoch ableiten. So sollten Objekte auch als solche auf dem Bildschirm dargestellt werden. Dazu werden umschließende Linien und geschlossene Farbflächen genutzt. Gliedernde Elemente wie Trennlinien sollten selbst keine Figuren, sondern Grund sein. Die Bildschirmelemente können durch Abstände in logisch getrennte Bereiche gegliedert werden. Da Oberflächen und ganze Objekte auch aus Andeutungen erkannt werden, kann eine dreidimensionale Darstellung auf dem Bildschirm genutzt werden. Wichtige Objekte im Vordergrund werden vollständig dargestellt, während im Moment nicht benötigte überdeckt im Hintergrund angezeigt werden.

Der Ansatz der Gestaltgesetze gibt Aufschluss darüber, wie Objekte dargestellt werden sollen. Er gibt keine Auskunft darüber, welche Objekte wann und wo angezeigt werden sollen. Der nächste Abschnitt beschäftigt sich deshalb mit einem anderen Bereich der Psychologie, der bei diesen Fragen helfen kann.

2.2 Mentale Modelle

"Die allgemeinste begriffliche Kennzeichnung der Inhalte des Langzeitgedächtnisses besagt, daß diese mentale Modelle der Außenwelt in allgemeiner, semantischer (‚Häuser haben Dächer‘) oder spezieller, episodischer Form (‚Mein Haus hat zwölf Fenster‘) darstellen." ([Glas94] S. 43) Mit ihrer Hilfe versucht der Mensch reale Vorgänge zu erklären und steuernd darauf einzuwirken. Die kognitive Psychologie definiert mentale Modelle als Modellierung von Prozessen (vgl. [Alle97] S. 49). Dabei fasst der Mensch mehrere Schritte eines Prozesses zusammen und sieht diese als Einheit mit bestimmten In- und Output. Der Output wird durch die mentalen Modelle "berechnet" und entspricht bei einem realen Prozess dem vorhergesagten Ergebnis. Die einzelnen Schritte sind nicht Inhalt des mentalen Modells, sondern vielmehr unbekannt. Mentale Modelle können nur indirekt beeinflusst werden.

Ein Benutzer besitzt für die von ihm zu erledigenden Aufgaben mentale Modelle. Diese sind je nach Vertrautheit mit dem Aufgabenbereich unterschiedlich stark ausgeprägt. Um ein Anwendungssystem nutzen zu können, muss der Benutzer sich von diesem ein mentales Modell bilden. Dieses Modell ist anfangs nur sehr vage und unvollständig. Der Benutzer versucht nun, dieses unvollständige Modell ständig zu erweitern und damit das Anwendungssystem zu erfassen und zu verstehen. Für ein schnelles Einarbeiten und effizientes Arbeiten ist es günstig, wenn mentales Modell und Anwendungssystem in möglichst vielen Punkten übereinstimmen. Das heißt, dass der vorhergesagte Output des mentalen Modells des Benutzers dem tatsächlichen Output des Softwaresystems entspricht. Ist der Benutzer mit dem Aufgabenbereich nicht vertraut, kann er sich bei Bildung seines mentalen Modells am Anwendungssystem orientieren. Soll das Computersystem jedoch bereits existierende Geschäftsprozesse unterstützen, so besitzt der Benutzer für diese bereits mentale Modelle. Wird ein Anwendungssystem entwickelt, das diesen entgegensteht, kann es sehr lange dauern, bis sich der Benutzer angepasst hat. In diesem Fall ist es günstiger, das Modell des Anwendungssystem dem mentalen Modell des Benutzers anzupassen. Allerdings ist zu beachten, dass der Einsatz von Software oftmals auch als Ansatz genutzt wird, bisherige Prozesse zu analysieren und optimieren.

Grundsätzlich kann davon ausgegangen werden, dass mentales Modell und Anwendungssystem nie ganz deckungsgleich sind. Aus diesem Grund müssen Mechanismen bereitgestellt werden, die den Anwender bestmöglich beim Erlernen des Modells unterstützen. Hilfreich sind dabei Hilfesysteme und Nutzung von Gleichnissen, auch Metaphern genannt.

2.3 Metaphern

Metaphern stellen einen wichtigen Aspekt im Softwaredesign dar. Metaphern sind die Überführung von bekanntem Wissen eines Gebietes auf ein anderes artfremdes Gebiet (vgl. [NeCa97] S. 441). Das Ziel beim Einsatz einer Metapher besteht darin, das Anwendungssystem an ein bekanntes Referenzsystem anzulehnen. Benutzer können damit bereits bekanntes Wissen nutzen und in einem neuen Kontext anwenden. Da ein Benutzer lediglich Analogien zwischen Quell- und Zielsystem ziehen muss, wird der Lernprozess erheblich beschleunigt. Die Quelle von Metaphern stellen bekannte Prozesse, Aufgaben und Situationen dar. Eine der bekanntesten Metaphern ist die Schreibtischmetapher. Sie beschreibt den Bildschirmaufbau des Betriebssystems als Schreibtisch. Dabei werden Objekte wie Dokumente oder Ordner so dargestellt, dass der Anwender sie sofort als solche erkennt. Auch die Funktionalität kann mittels einer Metapher ausgedrückt werden. So kann ein Benutzer ein Dokument mit der Maus direkt über den Papierkorb "ziehen" und "loslassen" (engl.: Drag and Drop) und damit löschen. Er hat jedoch auch die Möglichkeit, das Dokument wieder aus dem Papierkorb zurückzuholen und auf dem Schreibtisch wieder herzustellen. Metaphern werden jedoch nicht nur eingesetzt, um die Lernprozess zu beschleunigen. Durch die Nutzung von Gleichnissen ist auch eine einfachere, weil verständlichere Bedienung erreichbar.

Die Entwicklung zahlreicher Metaphern führte dazu, Klassifizierungen einzuführen. Hutchins unterscheidet drei Klassen (vgl. [NeCa97] S. 444f). Metaphern die an den Zielen des Benutzers ausgerichtet sind, zählt er zu den aktivitätsorientierten Metaphern. Die zweite Klasse beschreibt die grundlegende Interaktion zwischen Benutzer und Computer. Die aufgabenorientierten Metaphern beschreiben dagegen, wie eine Aufgabe strukturiert ist. Marcus unterscheidet lediglich zwischen den organisierenden und vorgangsbeschreibenden Metaphern. Unter Organisation versteht er Strukturen, Klassen, Objekte und Attribute. Zu beschreibenden Vorgänge sind Prozesse, Aktionen und Algorithmen. Es wurden weitere Klassifizierungen entwickelt, die den Oberflächenentwickler bei der Auswahl der passenden Metapher unterstützen sollen. Dies ist vor allem vor dem Hintergrund hilfreich, dass Metaphern selten einzeln, sondern meist in Kombination genutzt werden (vgl. [Prei99] S. 177).

Der Einsatz von Metaphern birgt jedoch auch Gefahren. Aus diesem Grund muss bei ihrem Einsatz auf Konsistenz geachtet werden. Unterscheiden sich die Annahmen und Erwartungen des Benutzers von der in der Software bereitgestellten Funktionalität entstehen Probleme. Die Metapher ist in diesem Fall irreführend und beeinträchtigt die Effizienz der Aufgabenerledigung. Es lassen sich drei verschiedene Konfliktbereiche identifizieren (vgl. [Prei99] S. 167). Das erste Problem kann darin liegen, dass das Anwendungssystem Funktionalität bereitstellt, die in der Analogie nicht möglich ist und somit nicht erfasst wird. Wählt man für ein Textverarbeitungsprogramm die Metapher der Schreibmaschine, so ist dem Benutzer die Funktion des automatischen Inhaltsverzeichnisses unbekannt. Die Metapher unterstützt den Anwender auch nicht, diese Funktionalität zu erforschen. Solche Aspekte müssen damit durch zusätzliche Mechanismen, wie beispielsweise Hilfesysteme dem Benutzer zugänglich gemacht werden. Der zweite Problembereich kann umgekehrt darin liegen, dass der Anwendung im Vergleich zur Analogie Funktionalität fehlt. Das hat zur Folge, dass der Benutzer vergeblich versuchen wird, die gewünschte Funktion auszuführen. Die dritte Klasse von Problemen tritt auf, wenn eine bestimmte Funktion zwar im Anwendungssystem und in der Analogie existiert, jedoch unterschiedlich reagiert. Das Ergebnis ist damit für den Benutzer nicht voraussagbar. Die dadurch bei der Anwendung auftretenden Fehler müssen anschließend durch den Benutzer im Rahmen des Fehlermanagement beseitigt werden. Weiterhin ist bei einem internationalem Einsatz der Software zu beachten, dass die verwendete Metapher in verschiedenen Kulturbereichen nicht immer die gleiche Aussage besitzen muss.

Auf Grund der zuvor aufgezeigten Probleme müssen die im Softwaresystem eingesetzten Metaphern bereits frühzeitig evaluiert werden. Damit kann vermieden werden, dass einerseits Funktionalität unerkannt und ungenutzt bleibt und das andererseits die Anwendung nicht überschätzt wird.

3 Design ergonomischer Oberflächen

Unter dem Design ergonomischer Oberflächen wird sowohl die Analyse als auch der Entwurf einer Benutzungsschnittstelle verstanden. Design und Evaluation einer Oberfläche stellen mit ca. 50 Prozent einen gewichtigen Anteil am gesamten Softwareentwicklungsprozeß dar.

Der Prozess der Oberflächenentwicklung gestaltet sich grundsätzlich in iterativer Art und Weise (vgl. [Prei99] S. 5f). Dies unterscheidet ihn von dem typischerweise phasenorientierten Software Engineering. Es ist nahezu unmöglich, beim ersten Versuch ein annehmbares Ergebnis zu erzielen. Das größte Problem besteht darin, dass sich die Anforderungen während der Entwicklung verändern. So können Benutzbarkeitsprobleme oft erst erkannt werden, wenn für die zu lösende Aufgabe auch ein Prototyp zur Verfügung steht. Eine weitere Ursache liegt in der Vielfalt der Aspekte, die eine Benutzungsschnittstelle beeinflussen. Diese besteht nicht nur aus visuellen Elementen, die auf dem Bildschirm angezeigt werden. Leistungsfähigkeit, Sicherheit, Unterstützung durch Hilfesysteme, Individualisierung, Organisation der Informationen oder Mehrsprachigkeit sind weitere Gesichtspunkte, die beachtet werden müssen. Die Besonderheiten des Entwicklungsprozess für Benutzungsschnittstellen haben zu dem von Nielsen geprägten Begriff Usability Engineering geführt. Ein so ausgerichteter Softwareentwicklungsprozeß stellt sich das Ziel, durch ergonomisches Design Effektivität bei höchstmöglicher Effizienz und Benutzerzufriedenheit zu gewährleisten. Usability Engineering ist durch einen engen Kontakt von Benutzern und Entwicklern charakterisiert. Typisch ist auch die Verwendung von Werkzeugen, um das Prototyping zu beschleunigen.

3.1

Usability Design

Die wörtliche Übersetzung von Usability ist Benutzbarkeit. Die DIN neigt jedoch dazu, dieses Wort mit Gebrauchstauglichkeit zu übersetzen (vgl. [Dzid94] S. 387). Im folgenden Beitrag werden beide Varianten synonym gebraucht. Die ISO definiert Gebrauchstauglichkeit als "das Ausmaß, in dem ein Produkt durch bestimmte Benutzer in einem bestimmten Nutzungskontext genutzt werden kann, um bestimmte Ziele effektiv, effizient und zufriedenstellend zu erreichen." ([ISO9241-11] S. 4) Der Nutzungskontext definiert die Benutzer, Arbeitsaufgaben, Arbeitsmittel (Hardware, Software und Materialien) sowie die physische und soziale Umgebung, in der das Produkt genutzt wird. Nielsen nennt fünf Eigenschaften von Softwaresystemen, die entscheidend die Benutzbarkeit beeinflussen. Dazu gehören Erlernbarkeit, Effizienz, Wiedererkennbarkeit, Fehlerbehandlung und Benutzerzufriedenheit (vgl. [Niel93] S. 26).

Beurteilt wird das Anwendungssystem von dem Benutzer mit seinen individuellen Bedürfnissen. Er spielt demzufolge die zentrale Rolle bei der Betrachtung der Gebrauchstauglichkeit. Aus diesem Grund schlägt die ISO 13407 einen benutzerorientierten Gestaltungsprozess vor. Dieser ist eine Art der Entwicklung interaktiver Systeme, die sich darauf konzentriert, Systeme gebrauchstauglich zu machen (vgl. [ISO13407] S. 2). Obwohl in der Norm explizit darauf hingewiesen wird, kann der Begriff "benutzerorientiert" fälschlicherweise so verstanden werden, lediglich die Belange des Benutzers zu berücksichtigen (vgl. Burm+00] S. 54). Aus diesem Grund wird synonym auch von der benutzerzentrierten Softwaregestaltung gesprochen, die eine aktive Einbeziehung des Benutzer klarer ausdrückt.

Der Gestaltungsprozess beginnt mit der Feststellung für die Notwendigkeit des benutzerorientierten Ansatzes. Steht Ausmaß und Umfang fest, kann ein interdisziplinäres Gestaltungsteam zusammengestellt werden, welches aus DV-Verantwortlichen, Entwicklern und Endbenutzern besteht. Dieses Team bleibt für die gesamte Projektdauer zusammen. Wurde ein der Größe des Projektes angepasstes Team gebildet, können die vier benutzerorientierten Gestaltungsaktivitäten durchlaufen werden (vgl. Anhang A.8). Im ersten Schritt wird der Nutzungskontext identifiziert (vgl. [ISO13407] S. 6ff). Dabei werden die Benutzermerkmale, Arbeitsaufgaben und die organisatorische und physische Umgebung analysiert. Abschnitt 3.2 beschäftigt sich mit diesen Aktivitäten eingehend. Im anschließenden zweiten Schritt werden daraus die Benutzeranforderungen und die organisatorischen Anforderungen abgeleitet. Das IEEE fordert, dass die Anforderungsspezifikation abstrakt, eindeutig, nachvollziehbar und überprüfbar ist. (vgl. Burm+00] S. 55). Das Entwerfen der Gestaltungslösungen ist Inhalt des dritten Schrittes. Er stellt die komplexeste Phase dar. Dabei können die Anforderungen mit Hilfe von Simulationen, Modellen oder Prototypen konkretisiert werden. Die Abschnitte 3.3 und 3.4 unterstützen bei der Grobgestaltung, zu der Navigationsstruktur und Informationspräsentation gehören. Für die Entwicklung von geeigneten Metaphern kann zusätzlich der Abschnitt 2.3 zu Rate gezogen werden. In der Feingestaltung werden grafische Gestaltung und Interaktionsverhalten bis ins Detail ausgestaltet. Dabei werden die in Kapitel 4 genauer betrachteten Style Guides verwendet. Der vierte Schritt des Gestaltungsprozesses besteht in der Beurteilung der Gestaltungslösungen gegenüber den Anforderungen. Die Beurteilung bzw. Evaluierung wird ausführlich in Kapitel 5 beschrieben. Sind die Anforderungen nicht erfüllt, wird erneut der erste Schritt des benutzerorientierten Ansatzes ausgeführt. Praktische Erfahrungen haben gezeigt, dass vor allem bei den ersten Iterationen erhebliche Verbesserungen der Gebrauchstauglichkeit zu erwarten sind. Der Gestaltungsprozess sollte mindestens eine Iteration aufweisen, wobei eine Zweite wünschenswert ist. Erfüllt die Gestaltungslösung die Anforderungen, so ist die Entwicklung abgeschlossen. Die ISO 13407 bietet im Anhang Formulare an, die bei der praktischen Umsetzung der vier Aktivitäten genutzt werden können. Die Norm berücksichtigt auch, dass bestimmte Benutzbarkeitsprobleme erst während der Anwendung über einen längeren Zeitraum erkannt werden können. Sie fordert daher Pläne und Verfahren für die Langzeitbeobachtung (vgl. [ISO13407] S. 9). So können durch eine Hotline oder eine Seite im Internet dem Benutzer Möglichkeiten zur Rückmeldung gegeben werden.

Wie bereits beschrieben, besteht der erste Schritt im benutzerorientierten Gestaltungsprozess aus der Identifikation von Aufgaben, Benutzern und Umgebung.

3.2

Aufgaben und Benutzeranalyse

Die Analyse von Benutzern und Aufgaben, ist eine zentrale Voraussetzung um eine ergonomische Oberfläche zu entwickeln. Ebenso entscheidend sind organisatorische und ökonomische Rahmenbedingungen. Dieser zweite Bereich wird an dieser Stelle nicht genauer betrachtet.

Eine 1997 durchgeführte Studie ergab, dass etwa 60 Prozent aller Benutzbarkeitsprobleme darauf zurückgehen, dass der Dialogablauf nicht dem Arbeitsablauf entspricht. Das heißt, dass die Benutzungsschnittstelle nicht optimal an die zu lösende Aufgabe angepasst ist (vgl. [GeHa98] S. 169). Inkonsistenz ist für 25 Prozent und Unübersichtlichkeit der Dialogelemente für 15 Prozent der Probleme verantwortlich. Der Entwicklungsprozess einer ergonomischen Oberfläche muss demzufolge mit einer Aufgabenanalyse beginnen.

3.2.1 Aufgabenanalyse

Dieser Arbeitsschritt wird im allgemeinen Softwareentwicklungsprozeß als Anforderungsanalyse bezeichnet. Im Bereich der Oberflächenentwicklung spricht man jedoch von der Aufgabenanalyse (vgl. [Olse98] S. 18). Das Ziel besteht darin, zu erkennen, was der Benutzer mit dem Anwendungssystem erreichen möchte, welche Strategien und Techniken er dabei benutzt und welche Informationen er für ihre Realisierung benötigt.

Da Benutzer und Softwareentwickler zwei verschiedene "Sprachen" sprechen, ist es wichtig, am Anfang des Projektes eine gemeinsame Kommunikationsbasis zu bilden (vgl. [Prei99] S. 210ff). Der Entwickler muss sich mit dem Handlungsumfeld des Benutzers beschäftigen, um einen Einblick in das Fachgebiet zu bekommen. Anschließend sollten Definitionen der verschiedenen Fachbegriffe aufgestellt werden. Sprechen beide Seiten die gleiche "Sprache", kann mit der systematischen Informationssammlung über die zu unterstützenden Aufgaben begonnen werden.

Für die Informationserfassung gibt es verschiedene Möglichkeiten. Die einfachste ist die Beobachtung. Für sie wird keine Vorbereitungsphase benötigt. Ebenfalls positiv ist der persönliche Kontakt zwischen beiden Parteien. Fragebögen und persönliche Interviews bieten die Möglichkeit, eine Vielzahl von Benutzern in die Analyse mit einzubinden. Allerdings muss bei diesen beiden Techniken mit einer größeren Vorbereitungszeit gerechnet werden. Fragebögen eignen sich insbesondere zur statistischen Auswertung. Ein Nachteil sind die unter Umständen langen Rücklaufzeiten. Im Ergebnis der Informationssammlung sollte der Entwickler wissen, welche Aufgaben existieren, wie sie bisher gelöst wurden, welche Probleme dabei auftreten und wie sich der Benutzer zukünftige Lösungen vorstellt. Anschließend sollte der Prozess der Aufgabenzerlegung beginnen. Shneiderman weißt auf dabei auftretende Schwierigkeiten hin. Werden zu kleine Teilaufgaben gebildet, können Benutzer durch die Vielzahl durchzuführender Aktionen bei der Aufgabenerledigung frustriert werden (vgl. [Shne98] S. 70). Sind die Teilaufgaben zu komplex, werden viele spezielle Optionen benötigt, die den Benutzer verwirren können. Im Anschluss an die Informationssammlung sollten Aspekte der Reihenfolge, Dauer und Häufigkeit einzelner Teilaufgaben bekannt sein. Ebenso wichtig ist eine Unterscheidung in kritische und unkritische Aufgaben. Kritische Aufgaben sind solche, welche bei fehlerhafter Ausführung entscheidend den Arbeitsablauf negativ beeinflussen. Bekannt ist auch, welche Informationen für die Aufgabenerledigung obligatorisch oder optional sind.

Im nächsten Schritt der Aufgabenanalyse werden Sequenzen von Handlungsschritten entworfen. Dabei ist zu definieren, welche Informationen vom Benutzer benötigt werden, welche das System liefern kann und welche Informationen an den Benutzer zurückgegeben werden müssen. Orientierungshilfen sind die oben genannten Aspekte. Häufig auftretende Handlungen sollten besonders schnell erreichbar sein. Bei ihnen ist auch auf eine angemessene Leistungsfähigkeit des Softwaresystems zu achten. Bei jeder Sequenz ist zu analysieren, ob Komplikationen auftreten können und welche Maßnahmen in diesem Fall einzuleiten sind. Mit diesem Wissen können bereits Aussagen über die zu verwendenden Interaktionsformen (vgl. Abschnitt 3.4.2) getroffen werden.

Den Abschluss der Aufgabenanalyse bildet die Auswertung. Bis zu diesem Punkt wurde die Aufgabenanalyse darauf beschränkt, den bisherigen Ablauf zu erfassen. Die Einführung eines neuen Softwaresystems sollte jedoch als Anlass genommen werden, Verbesserungsmöglichkeiten zu erkennen und einzuführen. In den seltensten Fällen ist die Art und Weise, wie die Aufgaben bisher erledigt wurden, optimal. Vor allem die Benutzer, als Experten auf ihrem Gebiet, können dabei wichtige Anstöße geben. Die erweiterten Möglichkeiten, die ein Softwaresystem bieten kann, beispielsweise der Einsatz von leistungsstarken Datenbanken, müssen dem Benutzer jedoch dargeboten werden. Werden diese neuen Techniken eingesetzt, ist eine qualitativ bessere Lösung der Aufgabenerledigung möglich.

3.2.2

Benutzeranalyse Kontakt zu den Benutzern eines Systems aufzubauen, ist für die Entwicklung von ergonomischen Benutzungsschnittstellen von großer Bedeutung. Nur dadurch kann eine angemessene Benutzeranalyse durchgeführt werden. Dabei muss zwischen Auftraggebern, d.h. dem Kunden und den Benutzern unterschieden werden. Zur Verdeutlichung wird deshalb auch von den Endbenutzern gesprochen (vgl. [Prei99] S. 214f). Um die Aufgaben genau zu analysieren müssen die Benutzer des Systems eingebunden werden. Sie kennen nicht nur die Abläufe und Ergebnisse, sondern vor allem die praktischen Probleme bei der Bewältigung der Aufgaben. Demgegenüber stehen die Auftraggeber. Sie können die Aufgaben des Anwendungssystems definieren, wissen jedoch weniger über die praktische Umsetzung. Doch vor allem die Betrachtung von Details führt zu einer ergonomischen Oberfläche. Außerdem hat die Einbeziehung der Benutzer einen wichtigen Nebeneffekt. Wie in der Organisationslehre herausgearbeitet wurde, können Individuen Veränderungen gegenüber ablehnend reagieren. Werden die Benutzer aktiv in den Entwicklungsprozess einbezogen und können das System mit gestalten, sinkt diese ablehnende Haltung. Ihre u.U. vorhandenen Ängste werden dadurch abgebaut. Wird das nicht beachtet, kann das im schlimmsten Fall zum Boykott und damit zum Scheitern des Projektes führen.

Benutzer unterscheiden sich in einer Vielzahl von Eigenschaften. Dazu zählen Alter, Geschlecht, physische Fähigkeiten, Ausbildung, kultureller und ethnischer Hintergrund, Motivation, Ziele und Persönlichkeit, um nur einige zu nennen (vgl. [Shne98] S. 67f). Diese verschiedenen Voraussetzungen müssen im Anwendungssystem berücksichtigt werden, um für alle Benutzer eine ergonomische Oberfläche anbieten zu können. Eine sorgfältige Analyse führt zur Bildung von Benutzergruppen. Übliche Einteilungen gliedern sich beispielsweise in Anfänger, erfahrene Benutzer und Experten. Eine Klassifikationen nach der Arbeitsaufgabe kann beispielsweise die drei Gruppen Lehrling, Sachbearbeiter und Abteilungsleiter ergeben. Ziel ist es, möglichst viele heterogene Individuen in homogene Gruppen einzuordnen. Die Auswahl der Kriterien hängt von dem konkreten Anwendungsfall ab. Sinnvolle Unterscheidungsmerkmale sind zum Beispiel Ziele oder die Fähigkeiten und Erfahrungen des Benutzers mit dem Anwendungsgebiet. Die Ermittlung der verschiedenen Gruppen kann ähnlich wie bei der Aufgabenanalyse mit Hilfe von Interviews und Fragebögen oder durch Beobachtung erfolgen. Hix und Hartson weisen darauf hin, dass vor allem die Beobachtung der Benutzer geeignet ist (vgl. [HiHa93] S. 128). Jede der identifizierten Benutzergruppen hat verschiedene Anforderungen an das Anwendungssystem. Da aus ökonomischen Überlegungen heraus nicht alle realisierbar sind, müssen im Vorfeld der Entwicklung Prioritäten gesetzt werden. Im allgemeinen wird man die meisten Zugeständnisse der Benutzergruppe mit den meisten Mitgliedern machen. Ein anderes Kriterium ist die Dauer bzw. Häufigkeit der Nutzung des Anwendungssystems.

Die Bildung von Benutzergruppen kann als Ausgangspunkt der Erstellung von Benutzermodellen angesehen werden. Ein Benutzermodell enthält explizite Annahmen über einen konkreten Benutzer, die es ermöglichen, dass das System auf diesen Benutzer zugeschnitten wird (vgl. [Prei99] S. 466). Die Annahmen bestehen im einfachsten Fall aus Attributen mit entsprechenden Werten. Die Erstellung und Verwaltung von Benutzermodellen durch das Anwendungssystem ist die Grundvoraussetzung für adaptive Systeme.

Die folgenden Ausführungen sollen den Sachverhalt verdeutlichen. Betrachtet man die zu lösende Aufgabe als Anwendungsbereich A, so kann S(A) als Anwendungssystem bzw. die Implementierung des Anwendungsbereiches bezeichnet werden (vgl. [Herc94] S. 18f). Das mentale Modell des Benutzers vom Anwendungsbereich wird durch B(A) beschrieben. Das Benutzermodell S(B(A)) ist somit das Modell des Systems vom mentalen Modell des Benutzers. Eine Inkompatibilität zwischen S(A) und B(A) führt bei der späteren Nutzung des Anwendungssystems zu Problemen. Diese Inkompatibilität resultiert im allgemeinen aus einem unzulänglichen Modell des Entwicklers vom mentalen Modell des Benutzers E(B(A)), kurz einer unzureichenden Benutzeranalyse.

3.3

Gestaltungsgrundsätze für Dialoge Unter dem Dialog zwischen Mensch und Maschine wird der wechselseitige Informationsaustausch zur Erfüllung einer Aufgabe verstanden (vgl. [Geis90] S. 141). Den hier betrachteten Dialog eines Anwendungssystems kann man als zielorientierte Interaktion zwischen Benutzer und Dialogsystem definieren. D.h., dass eine Benutzungsschnittstelle aus mindestens einem, meist aber aus mehreren Dialogen besteht. Die Initiative für den Informationsaustausch kann sowohl vom Menschen als auch von der Maschine ausgehen und kann während des Dialogverlaufes wechseln. Ziel des Dialoges ist eine Benutzerführung. Der Anwender soll bei der Erledigung seiner Aufgabe unterstützt werden. Ein guter Dialog vermeidet dabei jegliche Über- oder Unterforderung des Menschen. Die vorher durchgeführte Benutzeranalyse hilft bei der Umsetzung dieser Forderung. Ein Dialog sollte selbsterklärend sein (vgl. Abschnitt 3.3.2). D.h., dass der Anwender den Dialog selbstständig, ohne fremde Hilfe benutzen kann. Das bedeutet jedoch nicht, dass auf die Einführung eines Anwendungssystems, die mit einer Schulung verbunden sein kann, verzichtet werden darf. Weiterhin ist durch die Dialoggestaltung sicherzustellen, dass das System vom Benutzer akzeptiert wird. Die Anpassung des Dialoges an die Fähigkeiten des Benutzer sollte ebenso möglich sein (vgl. Abschnitt 3.3.6). Diese kann entweder durch den Benutzer erfolgen, oder durch das System automatisch vorgenommen werden.

Um einen Dialog nach seiner Brauchbarkeit zu bewerten, werden angemessene Kriterien benötigt. Benutzungsschnittstellen sind jedoch "sehr inhomogene und vieldimensionale Gebilde, die sich weitgehend einer direkten, objektiven Messung entziehen." ([Herc94] S. 104) Dennoch gibt es eine Reihe von Merkmalen, die eine Bewertung ermöglichen. Die ISO 9241 definiert sieben Grundsätze der Dialoggestaltung (vgl. [ISO9241-10]). Diese sind nicht unabhängig voneinander. So kann es nötig sein, Vorteile des einen Grundsatzes gegenüber denen eines anderen abzuwägen. Im folgenden werden die Grundsätze einzeln beschrieben.

3.3.1

Aufgabenangemessenheit

Die ISO 9241-10 definiert einen Dialog als "aufgabenangemessen, wenn er den Benutzer unterstützt, seine Arbeitsaufgabe effektiv und effizient zu erledigen." ([ISO9241-10] S. 4)

Ein Dialog sollte nur die Informationen anzeigen, die für die zu erledigende Aufgabe relevant sind. Damit soll eine Reizüberflutung des Benutzers vermieden. Entwickler bieten oft überflüssige Informationen an, weil beispielsweise die bei der Programmierung verwendete Komponente diese Funktionalität bietet. Die Frage, ob damit die Erledigung der Arbeitsaufgabe erleichtert wird, wird oft nicht gestellt. Die Darstellung der Informationen muss dabei an die Arbeitsaufgabe angepasst werden. So sollten beispielsweise lange Listen nach Vorgabe des Benutzer sortiert werden können. Die Anzeige der Genauigkeit von Zahlen wird nicht von den technischen Möglichkeiten sondern von der Aufgabe vorgegeben. Aufgabenangemessenheit bedeutet auch, dass das Dialogsystem automatisierbare Arbeitsschritte auch selbständig ausführt. So können Positionsmarken im vorhinein sinnvoll platziert werden oder Startprozeduren automatisch vom System ausgeführt werden. Bei der Dialoggestaltung ist sowohl der Grad an Komplexität der Aufgabe als auch die Qualifikation des Benutzers zu beachten. So müssen beispielsweise bei komplizierten Aufgaben die Hilfetexte entsprechend umfassend die einzelnen Teilprobleme erläutern. Die auf Verlangen des Benutzer angezeigte Hilfe sollte sich mit der gegenwärtig zu bearbeitenden Aufgabe beschäftigen. Innerhalb des Hilfesystems kann dann der Benutzer zu anderen Themenbereichen navigieren (vgl. Abschnitt 3.4.6). Eine weitere Forderung besteht in der Vorgabe von Standardwerten. Diese müssen sinnvoll ausgewählt und durch den Benutzer veränderbar sein. Vor allem bei Datumseingaben tritt häufig der Fall auf, dass das aktuelle Datum eingegeben werden muss. Das Eingabefeld kann in diesem Fall vom Anwendungssystem gefüllt werden. Enorme Zeiteinsparungen lassen sich auch erreichen, wenn häufig wiederkehrende Aufgaben speziell behandelt werden können. Es sollte möglich sein, diese zu automatisieren und damit zu beschleunigen. Im allgemeinen wird das durch den Einsatz von Makros realisiert (vgl. Abschnitt 3.4.8). Werden während der Erledigung einer Aufgabe Daten geändert, sollte dem Benutzer möglich sein, die ursprünglichen Daten wieder herzustellen. So kann beispielsweise die Eingabe in einem Textfeld durch Drücken der Taste ESC wieder zurück gesetzt werden. Deutlich mächtiger als dieser einfache Mechanismus ist eine Undo-Funktion, die ganze Dialogschritte rückgängig machen kann (vgl. Abschnitt 3.3.3). Die letzte Forderung besteht in der Vermeidung unnötiger Arbeitsschritte. So kann beispielsweise das Drucken und Schließen einer Rechnung in einem Schritt durchgeführt werden.

Die Effizienz des Dialoges hängt entscheidend von der Anpassung des Systems an die Aufgabe ab. Die in Abschnitt 3.2.1 beschriebene Aufgabenanalyse ist dafür die Voraussetzung. Die benutzergerechte Gestaltung kann mit der Anpassung an die Aufgabe konkurrieren. In diesen Fällen muss ein Kompromiss gefunden werden.

3.3.2

Selbstbeschreibungsfähigkeit

"Ein Dialog ist selbstbeschreibungsfähig, wenn jeder einzelne Dialogschritt durch Rückmeldung des Dialogsystems unmittelbar verständlich ist oder dem Benutzer auf Anfrage erklärt wird." ([ISO9241-10] S. 5)

Diese Erläuterungen stellen eine Ergänzung der vorher durchgeführten Benutzerschulung dar, keinen Ersatz. Hilfetexte sollen es dem Benutzer erleichtern, sich schnell und problemlos ein mentales Modell des Anwendungssystems aufzubauen. Die Erläuterungen müssen den Kenntnissen des Benutzer angepasst sein. So kann vor allem bei Anfängern die Darstellung von Beispielen hilfreich sein. Die Texte sollten sowohl die Muttersprache des Anwenders als auch die Fachbegriffe des Arbeitsgebietes verwenden. Ein Dialogsystem sollte nach jeder Handlung des Benutzers eine Rückmeldung geben. Wird vom Benutzer ein Arbeitsschritt initiiert, der schwerwiegende Folgen haben kann, sollte zuvor eine Bestätigung verlangt werden. Dabei sollte der Benutzer die Möglichkeit haben, sich dazugehörige Erläuterungen anzeigen zu lassen. Das Dialogsystem sollte sicherstellen, dass der Benutzer immer über den gegenwärtigen Dialogzustand informiert ist. Dazu gehört beispielsweise ein Überblick über vergangene und zukünftige Dialogschritte. Wird eine Eingabe verlangt, sollten dem Benutzer Informationen darüber angezeigt werden. Ein Beispiel ist die Anzeige des erwarteten Formates. Das Hilfesystem (vgl. Abschnitt 3.4.6) sollte die Erläuterungen kontextabhängig anbieten. Das bedeutet, dass in Abhängigkeit der aktuellen Dialogsituation ein an den Anwendungszustand orientierter Text angeboten wird. Merkmale der Dialogsituation stellen beispielsweise das ausgewählte Fenster, der Eingabefokus, oder der aktuelle Bearbeitungsschritt der Aufgabe dar. Hilfetexte können aktive oder passiv sein. Ersteres bedeutet, dass der Benutzer die Initiative übernimmt und durch eine entsprechende Eingabe die Anzeige von Erläuterungen fordert. Aktive Hilfe sind automatisch vom System angebotene Erläuterungen. Ein Beispiel wäre die Anzeige eines Hilfetextes nach einem Eingabefehler.

3.3.3

Steuerbarkeit "Ein Dialog ist steuerbar, wenn der Benutzer in der Lage ist, den Dialogablauf zu starten sowie seine Richtung und Geschwindigkeit zu beeinflussen, bis das Ziel erreicht ist." ([ISO9241-10] S. 6) Das heißt, dass die Kontrolle, soweit es die Aufgabe zulässt, beim Benutzer liegen soll. Parallel durchführbare Aufgaben müssen auch gleichzeitig abzuarbeiten sein. Das System sollte in mehrere unterbrechbare und wieder fortsetzbare Teildialoge gegliedert werden. Auf modale Dialoge, die einen Wechsel in einen anderen Dialog ohne vorherige Beendigung verhindern, sollte beim Systementwurf verzichtet werden. Ausgeschlossen sind kritische Vorgänge, wie zum Beispiel Fehlermeldungen. Bei Systemen mit hohem Sicherheitsbedürfnis ist ebenfalls von zu großer Freiheit für den Benutzer abzusehen und ein systemgesteuerter Dialog vorzuziehen. Die Geschwindigkeit des Dialoges sollte dem Benutzer nicht vorgeschrieben werden. So wird beispielsweise das Ende der Eingabe in einem Feld mit der Taste ENTER durch den Benutzer signalisiert. Der Benutzer sollte selbst die Interaktionsform auswählen können (vgl. Abschnitt 3.4.2). So bevorzugen Anfänger beispielsweise die Funktionsauswahl über Menüs, während Experten lieber Kommandos verwenden. Die ISO 9241 subsumiert unter dem Begriff Steuerbarkeit auch die Forderung nach Stornierbarkeit von Aktionen. Es sollte wenigstens der letzte Dialogschritt, soweit seine Folgen reversibel sind, zurückgenommen werden können. Diese Technik wird als Undo bezeichnet. Durch die Möglichkeit die letzte Aktion rückgängig zu machen, wird der Anwenders angeregt, das Anwendungssystem zu explorieren. Die Angst, einen Fehler zu begehen wird entscheidend gesenkt. Soweit möglich sollte das System nicht nur für den letzten, sondern für alle gemachten Schritte ein Undo ermöglichen. Möchte der Benutzer etwas ausprobieren, ist meist eine gewisse Anzahl von Arbeitsschritten notwendig, um das Ergebnis zu erhalten. Wird diese Technik unterstützt, sollte die direkte Wahl des entsprechenden Undo-Schrittes möglich sein, um mehrere Arbeitsschritte auf einmal rückgängig zu machen. Da sich der Benutzer nur bis zu einen gewissen Grad die letzten Aktionen merken kann, muss in diesen Fällen die Anzeige der Schritte auch eine kurze Erläuterung beinhalten. Die Rücknahme einer Undo-Operation wird mit Redo bezeichnet.

3.3.4 Erwartungskonformität

"Ein Dialog ist erwartungskonform, wenn er konsistent ist und den Merkmalen des Benutzers entspricht, z. B. seinen Kenntnissen aus dem Arbeitsgebiet, seiner Ausbildung und seiner Erfahrung sowie den allgemein anerkannten Konventionen." ([ISO9241-10] S. 6)

Während sich die Erfahrungen des Benutzers bei der Arbeit mit dem System immer mehr ausweiten, schränkt sich die Menge der Erwartungen immer mehr ein. Stimmen die Erwartungen des Benutzers mit dem tatsächlichen Systemverhalten überein, so ist das Anwendungssystem konsistent. Dazu sollte Dialogverhalten und Informationsdarstellung innerhalb des Dialogsystems einheitlich sein. Hierbei helfen sowohl der Einsatz von Standardkomponenten als auch Style Guides. Eine Änderung des Dialogzustandes sollte auf einheitliche Weise herbeigeführt werden. Dazu zählen der einheitliche Aufruf des Hilfesystems oder der Abbruch eines Dialogs mit der Taste ESC. Der Einsatz eines einheitlichen, dem Benutzer vertrauten Wortschatzes steigert nicht nur die Selbstbeschreibungsfähigkeit sondern auch die Erwartungskonformität. Die Gestaltung von ähnlichen Aufgaben sollte immer gleich sein. Damit kann der Benutzer ein bekanntes Verfahren leicht abgewandelt wieder einsetzen. Zusätzlich ist ein hoher Grad an Konsistenz von Bedeutung, da er das Lernen vereinfacht und unnötige Belastungen für den Benutzer vermeidet. Es lassen sich drei Arten von Konsistenz unterscheiden (vgl. [Herc94] S. 112). Die Einheitlichkeit der Dialoge innerhalb einer Anwendung wird als innere Konsistenz bezeichnet. Sie muss durch den Dialogentwickler sichergestellt werden. Dabei haben Verwendung, Positionierung, Farbe und Verhalten von Bildschirmelementen einen großen Einfluss. Die äußere Konsistenz beschreibt die Einheitlichkeit von Dialogen verschiedener Anwendungssysteme. In diesem Bereich wirken die Richtlinien und Techniken des zugrunde liegenden Betriebssystems unterstützend. Die metaphorische Konsistenz beschreibt die Einheitlichkeit der Dialoge mit der realen Arbeitswelt (vgl. Abschnitt 2.3). Insbesondere die Aufgabenanalyse hilft dabei, eine entsprechende Metapher zu entwickeln.

3.3.5 Fehlertoleranz

"Ein Dialog ist fehlertolerant, wenn das beabsichtigte Arbeitsergebnis trotz erkennbar fehlerhafter Eingaben entweder mit keinem oder mit minimalem Korrekturaufwand seitens des Benutzers erreicht werden kann." ([ISO9241-10] S. 7)

Fehler und Probleme im Umgang mit Software treten alltäglich auf. Etwa 10 Prozent der Computerarbeitszeit verbringen Benutzer damit, diese zu bewältigen (vgl. [Kens+95] S. 217). Damit stellen sie nicht nur eine zusätzliche Belastung für den Benutzer dar, sondern verursachen ferner für das Unternehmen hohe Kosten. Fehler sind immer vom aktuellen Arbeitskontext abhängig und bedürfen daher spezifischer Behandlung. Syntaktische Fehler sind vom System erkennbar. Eine Korrektur kann automatisch oder manuell erfolgen. Wird der Fehler automatisch korrigiert, beispielsweise Tippfehler, muss der Benutzer darauf hingewiesen werden, ohne jedoch den Dialogablauf zu stören. In dem genannten Fall kann die Eingabe korrigiert angezeigt werden, was als Hinweis ausreichend ist. Die automatische Fehlerkorrektur muss abschaltbar sein. Bei manueller Fehlerbeseitigung muss eine Fehlermeldung erfolgen, die in ihrer Ausführlichkeit anpaßbar ist. Das erlaubt unerfahrenen Benutzern sich über den Grund des Fehlers ausführlich zu informieren, während Experten mit diesen Informationen nicht belästigt werden. Zusätzlich sollte der Benutzer bei der Behebung des Fehlers unterstützt werden. Vorhandene Alternativen können dargestellt und erläutert werden. Die Fehlermeldungen selbst sind verständlich, sachlich und konstruktiv zu formulieren. Sie sollten einheitlich strukturiert werden. Dazu gehört sowohl der Aufbau des Fehlertextes als auch seine Darstellung.

Das Ziel beim Entwurf des Anwendungssystems besteht darin, das Auftreten von Fehlern zu vermeiden. So können Eingaben beschränkt werden, indem z.B. keine Ziffern in Textfeldern mit Zahlen als Inhalt erlaubt sind.

Semantische Fehler treten immer dann auf, wenn das mentale Modell des Benutzers von dem tatsächliches Modell des Anwendungssystems abweicht. Sie können vor allem durch erwartungskonforme Systeme und den Einsatz geeigneter Metaphern eingegrenzt werden.

3.3.6

Individualisierbarkeit "Ein Dialog ist individualisierbar, wenn das Dialogsystem Anpassungen an die Erfordernisse der Arbeitsaufgabe sowie an die individuellen Fähigkeiten und Vorlieben des Benutzers zulässt." ([ISO9241-10] S. 8) Umfassende Individualisierungsmöglichkeiten sind keine Rechtfertigung, auf die ergonomische Gestaltung von Dialogen zu verzichten. Die Möglichkeiten der Anpassung müssen durch den Entwickler sinnvoll begrenzt werden. Damit sollen Beeinträchtigungen durch Individualisierung vermieden werden. Beispielsweise darf es nicht möglich sein, die Lautstärke eines Audiosystems soweit zu erhöhen, dass Hörschäden entstehen können.

Grundsätzlich sollten Techniken zur Anpassung an Sprache und kulturelle Eigenheiten bereit gestellt werden. Dieser Aspekt wird unter dem Begriff Internationalisierung diskutiert. Weiterhin sollten sensomotorische und geistige Fähigkeiten des Benutzers beachtet werden. So ist beispielsweise für farbenfehlsichtige Anwender die Anpassung von Farben ein wichtiges Kriterium. Das Wissen der Benutzer und ihre Erfahrungen im Aufgabenbereich und mit dem Anwendungssystem sind unterschiedlich und unterliegen einem stetigen Wandel. Dementsprechend sollten Individualisierungsmöglichkeiten auch diesen Bereich abdecken. Ein Beispiel ist die Anpassung des Umfanges von Hilfetexten. Die Darstellung von Informationen sollte ebenfalls änderbar sein. So bevorzugen manche Benutzer eine Listendarstellung, während andere die Darstellung in Karteiform präferieren. Auch wenn in der Anwendung der Wortschatz des Arbeitsgebietes verwendet wurde, sollte es dem Benutzer erlaubt sein, eigene Bezeichnungen festzulegen. Die letzten Forderungen sind Anpassung von Kommandos und die Wahl der Interaktionsform. Die Kommandoanpassung umfasst sowohl ihre Bezeichnung als auch die Funktionalität. Als Beispiel können die in Abschnitt 3.3.1 erwähnten Makros genannt werden.

3.3.7 Lernförderlichkeit

"Ein Dialog ist lernförderlich, wenn er den Benutzer beim Erlernen des Dialogsystems unterstützt und anleitet." ([ISO9241-10] S. 9)

Lernen als das Erarbeiten einer möglichst geeigneten Vorgehensweise oder Strategie zur Erfüllung einer gegebenen Aufgabe durch wiederholte Übung (vgl. [Joha93] S. 147) ist für die effiziente Nutzung eines Softwaresystems von großer Bedeutung. Umfangreiche Systeme können auch durch einführende Schulungen nicht von Anfang an umfassend erfasst und in ihrer ganzen Funktionalität genutzt werden. Vielmehr sollte der Benutzer unterstützt werden, selbstständig sein Wissen über das System während seiner Nutzung zu verbessern und zu erweitern. Dabei helfen die bereits erwähnten Metaphern, die es ermöglichen, bereits vorhandenes Wissen in den neuen Bereich zu transferieren. Eine Hilfefunktion wirkt ebenfalls unterstützend. Die im Abschnitt 3.3.3 erläuterte Undo-Funktion unterstützt das "Learning-by-doing". Bei diesem Konzept soll der Anwender während der Erledigung einer Aufgabe lernen. Werden Schritte ausgeführt, die fehlerhafte Auswirkungen haben, können sie jederzeit wieder rückgängig gemacht werden.

Die Lernförderlichkeit eines Anwendungssystems ist auch wichtig, weil Benutzer die Eigenschaft besitzen, Funktionen und Abläufe die länger nicht genutzt wurden, wieder zu vergessen. In diesen Fällen reicht ein kurzes Wiederauffrischen des bereits Gelernten. Kurze Hinweise in Form von Tipps (vgl. Abschnitt 4.2.23) können dabei bereits ausreichen. Ein wichtiger Nebeneffekt besteht darin, dass Lernen bei der Benutzerzufriedenheit ein positiven Einfluss besitzt.

3.4 Entwurfstechniken

Die im vorherigen Abschnitt herausgearbeiteten Gestaltungsgrundsätze müssen bei der Entwicklung einer Benutzungsschnittstelle umgesetzt werden. Erst damit kann eine ergonomische Oberfläche entstehen. Es gibt eine Vielzahl von Prinzipien und Techniken, die dabei helfen können. Diese sind allgemeiner formuliert als konkrete Style Guides. Die Palette der Möglichkeiten ist jedoch zu weit gefächert, als das eine umfassend vollständige Beschreibung aller Aspekte möglich wäre. Aus diesem Grund werden die wichtigsten Prinzipen ausgewählt und diskutiert. Die einzelnen Techniken sind meist von mehreren Gestaltungsgrundsätzen beeinflusst. So unterstützt beispielsweise die Anwendung von Icons die Selbstbeschreibungsfähigkeit und Lernförderlichkeit. Die Auswahl der Interaktionsform wirkt sich dagegen hauptsächlich auf die Steuerbarkeit von Anwendungssystemen aus.

Die hier aufgeführte Reihenfolge der einzelnen Techniken steht nicht im Verhältnis zur ihrer Wichtigkeit. Vielmehr sollten alle Prinzipien beachtet und benutzt werden. Den Grad der Intensität geben die Rahmenbedingungen des Entwicklungsprojektes vor. Zu diesen gehören sowohl die Aufgabe und die Benutzer als auch finanzielle Gesichtspunkte. So wirken Sicherheitsabfragen innerhalb eines Systems erschwerend bei der Benutzung, können aber äußerst nützlich und somit sinnvoll sein. In diesen Fällen müssen Kompromisse eingegangen werden.

3.4.1

Fenstersysteme

Grafische Fenstersysteme werden heute in den meisten Computersystemen als Dialogform genutzt. Durch sie ist eine bessere Abbildung der menschlichen Gedankenwelt möglich, als das auf textueller Kommunikation beruhende Dialogsysteme vermögen (vgl. [Prei99] S. 77). Ein Fenster beschreibt dabei einen "separat steuerbaren Bereich auf dem Bildschirm, der zur Darstellung von Objekten und/oder zur Durchführung eines Dialogs mit dem Benutzer verwendet wird." ([ISO9241-16] S. 5) Es bietet dem Benutzer eine Sicht auf das Anwendungssystem. Durch die Verwendung mehrerer Fenster und damit unterschiedlicher Sichten kann dem Anwender ein umfassendes Verständnis der Anwendung und ihres aktuellen Zustandes vermittelt werden.

In den meisten grafischen Systemen können eine Vielzahl von Anwendungen simultan ablaufen (vgl. [Olse98] S. 91). Dabei besteht jede aus einem Haupt- und mehreren Unterfenstern. Um eine unnötige Konfusion zu vermeiden, werden grafische Benutzungsschnittstellen auf der Grundlage von Basis-Window-Systemen entwickelt. Diese werden durch zwei Aspekte charakterisiert. Zum einem bieten sie Softwaredienste an, die es Anwendungen ermöglichen, sowohl eigene Fenster zu erstellen und zu organisieren als auch diese mit Interaktionselementen zu füllen. Andererseits gestattet das Basis-Window-System dem Benutzer Größe und Position der Fenster zu kontrollieren. Die dafür zuständige Softwarekomponente wird als Fenstermanager bezeichnet.

Damit eignen sich Fenstersysteme ideal für die parallele Bearbeitung mehrerer Aufgaben. Diese kann sowohl anwendungsintern als auch anwendungsübergreifend stattfinden. Durch überlappende Darstellung der Fenster können dem Benutzer die vorhandenen Prozesse angezeigt werden. Diese Darstellung unterstützt die Schreibtischmetapher. Genau wie beim Stapeln von Dokumenten, ist nur das zu oberst liegende komplett sichtbar. Entsprechende Auswahlmechanismen, um das aktuelle Fenster festzulegen, müssen durch das Anwendungssystem bereit gestellt werden. Die einfachste Möglichkeit ist das Anklicken mit einem Zeigegerät wie der Maus. Da Fenster nicht zwingend angezeigt werden, sondern auch komplett verdeckt sein können, müssen innerhalb der Anwendung Alternativen angeboten werden. Eine Auswahl mittels Menü umgeht das genannte Problem.

Sowohl die Größe als auch die Position von Fenstern kann vom Benutzer verändert werden. Ist durch den speziellen Anwendungsfall diese Freiheit nicht sinnvoll, kann sie beispielsweise durch Angabe der maximalen Größe beschränkt werden. Ein wichtiges Kriterium bei Fenstersystemen ist die Platzierung der Fenster. In den meisten Fenstermanagern, wie z.B. Microsoft Windows, sind zwar Strategien integriert, diese sind jedoch unzureichend. So betreffen die Befehle zur Neuanordnung der Fenster alle im derzeitigen Nutzungskontext erreichbaren Fenster. Damit lassen sich Operationen nicht gezielt auf Fenster anwenden, die für eine bestimmte Aufgabe erforderlich sind. Es gibt zwar den Mechanismus einer Eltern - Kind Beziehung, diese Einteilung wird jedoch durch den Entwickler vorgenommen und ist für den Benutzer unzugänglich. Beim Anzeigen eines neuen Fensters sollte vom System sichergestellt werden, dass es wichtige Bildschirmbereiche nicht verdeckt. So darf der Dialog zum Suchen und Ersetzen bei der Sicherheitsabfrage nicht das Objekt überlappen, welches ersetzt werden soll. Fenster sollten sich nach Möglichkeit ihre letzte Position und Größe "merken". Üblicherweise entwickelt ein Benutzer während der Arbeit mit dem Anwendungssystem eine Fensteranordnung, die er auch zukünftig präferiert. Im entwickelten Prototyp wurden dafür zwei Methoden eingeführt, die diese Arbeit automatisch übernehmen (vgl. Abschnitt 4.2.1). Fenster bieten die Möglichkeit, Daten von einem Fenster in ein anderes zu transferieren. Dies erhöht die Effizienz bei der Aufgabenerledigung, da eine redundante Erstellung der Daten nicht notwendig ist. Im allgemeinen wird dieser Mechanismus mittels einer Zwischenablage realisiert.

Werden mehrere Aufgaben gleichzeitig abgearbeitet, werden entsprechend viele Fenster benötigt. Dabei kann die Bildschirmorganisation unübersichtlich werden, was zur Verwirrung des Benutzer führt. Dieser beschäftigt sich dadurch sehr lange mit der Verwaltung der Fenster. Die Effizienz der Aufgabenerfüllung sinkt. Virtuelle Bildschirme sind eine Technik, um das zu verhindern. Der Bildschirm wird in eine Raummetapher gewandelt. Dabei kann der Benutzer verschiedene Fenster gruppieren und diese einem Raum zuordnen. Zwischen den einzelnen Räumen kann der Benutzer beliebig hin und her wechseln, wobei der jeweils aktuelle Raum bildschirmfüllend dargestellt wird.

Kruschinski gibt einige grundsätzliche Richtlinien zum Aufbau von Fenstern (vgl. [Krus99] S. 36ff). Ein Fenster sollte nur die für die Teilaufgabe relevanten Informationen anzeigen. Diese sind allerdings vollständig darzustellen. D.h., dass alle benötigten Informationen direkt im Fenster zugänglich sind. Die Informationsdichte eines Fensters sollte zwischen 25 Prozent und 40 Prozent liegen. Sie wichtet den durch die Interaktionselemente benötigten Platz mit der gesamten Größe des Fensters. Einer der wichtigsten Aspekte der Fenstergestaltung ist die Einhaltung der Konsistenz. Ein gleichartige Struktur hat verschiedene Vorteile. So sinkt beispielsweise sowohl die Lernzeit als auch Suchzeit des Benutzers, was gleichzeitig zu einer Steigerung der Effizienz führt. Als letzter Punkt ist bei der Gestaltung von Fensters auf ein harmonisches Erscheinungsbild zu achten. Dabei sind die wichtigsten Faktoren Proportion, Balance, Vorhersagbarkeit, Symmetrie, Einfachheit, Klarheit und Sequenz. Diese werden an dieser Stelle jedoch nicht eingehend diskutiert. Kruschinski gibt in seiner Arbeit einen ausführlichen Überblick darüber (vgl. [Krus99] S. 41ff).

3.4.2

Interaktionsformen Bei der Nutzung von Anwendungssystemen treten bestimmte Aktionen in gleicher oder ähnlicher Form immer wieder auf. Die Aktionen werden als Interaktionsaufgaben bezeichnet (vgl. [Prei99] S. 117). Sie drücken aus, was der Benutzer machen kann. Die Interaktionsaufgaben können in verschiedener Art und Weise durch den Anwender durchgeführt werden. So kann er beispielsweise zwischen Maus- oder Tastatureingabe auswählen. Die verschiedenen Möglichkeiten werden als Interaktionsform bzw. synonym Interaktionstechnik bezeichnet. Sie drücken aus, wie der Benutzer etwas machen kann. Grundsätzlich lässt sich die Aussage treffen, dass die Interaktionsform sowohl von der zu erledigenden Aufgabe als auch von dem Benutzer abhängt. Im folgenden werden die wichtigsten Interaktionstechniken näher beschrieben. Obwohl hier eine getrennte Betrachtung stattfindet, werden sie in der Praxis meist gemischt verwendet.

3.4.2.1 Deskriptive Interaktion

Die deskriptive Interaktion basiert auf der Verarbeitung von Sprache. Dabei kann sowohl eine Kommandosprache als auch natürliche Sprache eingesetzt werden. Die Kommandosprache war eine der ersten Interaktionsformen von Benutzungsschnittstellen (vgl. [HiHa93] S. 82). Sie besteht aus einer kontextfreien Grammatik, deren Schlüsselwörter mit möglichst wenig Buchstaben auskommen. Aus diesem Grund muss diese Sprache vom Benutzer erlernt werden. Wird sie beherrscht, stellen die Kommandos eine äußerst effiziente Methode dar, mit dem System zu kommunizieren. Unterstützend kann eine AutoComplete-Funktion vom System angeboten werden (vgl. [Prei99] S. 119). Wird ein Kommando während der Eingabe erkannt, obwohl es noch nicht komplett eingegeben wurde, so kann es vom System automatisch ergänzt werden. Der Einsatz von Aliasnamen, d.h. die Definition eines normalerweise kürzeren Wortes für ein Kommando ermöglicht weitere Effizienzsteigerungen. Ein wichtiger Aspekt bei Kommandosprachen stellt das Hilfesystem dar. Shneiderman betont, dass ein solches nur schwer anzubieten ist (vgl. [Shne98] S. 73). Es existieren jedoch Möglichkeiten, auch diese Interaktionsform entsprechend zu unterstützen. So sollte der Benutzer möglichst schnell sowohl verfügbare Kommando als auch seine Parameter einsehen können. Bei fehlerhafter Eingabe kann automatisch eine Übersicht entweder der Parameter oder der lexikalisch benachbarten Kommandos angeboten werden. Fehlende Angaben können durch Standardwerte ergänzt werden.

Kommandosprachen besitzen viele Vorteile. Sie erfordern keine speziellen Eingabegeräte und sind universell hinsichtlich der Ausdrucksmächtigkeit. Bei Beherrschung der Syntax können Aufträge aller Art effizient formuliert werden (vgl. [Ober94] S. 119). Die Aufzeichnung eines Protokolls ist sehr leicht umzusetzen. Die Definition von Makros gestaltet sich für den Benutzer unproblematisch. Neben den Vorteilen existieren jedoch auch erhebliche Nachteile. So müssen die Kommandos gelernt werden um aus dem Gedächtnis abrufbar zu sein. Eine flüssige Interaktion erfordert eine schnelle und fehlerfreie Tastatureingabe. Abkürzungen, Standards und Makros können dabei unterstützend wirken, erhöhen jedoch den Lernaufwand. Der Wirkungsbereich von Kommandos umfasst das gesamte System. Aus diesem Grund sind die Auswirkungen eines Kommandos für den Benutzer schwer zu kontrollieren. Der hohe Lernaufwand gepaart mit der konsequenten Ausrichtung auf Effizienz prädestiniert diese Interaktionsform für professionelle Benutzer.

Die Interaktion über natürliche Sprache geht von der gewohnten Sprache des Menschen aus. Sie erfordert deshalb keinen zusätzlichen Lernaufwand. Damit ist sie für Gelegenheitsnutzer bzw. Anfänger gut geeignet. Bei ihnen sinkt vor allem bei umfangreichen Datenmengen die Effizienz der Eingabe. Das Hauptproblem bei natürlich-sprachlichen Systemen besteht jedoch in ihrer Interpretation. Die Bedeutung der Eingabe hängt stark vom Kontext ab. Tritt ein solcher mehrdeutiger Fall auf, muss das System einen Klärungsdialog initiieren, der wiederum die Effizienz mindert. Da die natürliche Sprache mit bis zu 300.000 Wörtern ein extrem umfangreiches Vokabular besitzt, können heutige Anwendungssysteme nur einen kleinen Teil kennen und verarbeiten.

Das Gebiet der deskriptiven Interaktionsformen gewinnt in letzter Zeit wieder an Bedeutung. Grund dafür ist die Einführung der Spracheingabe. Die Steuerung von Computern über Sprache, beispielsweise bei Fahrzeugnavigation oder -telefonie, wird auch in Zukunft weiter an Bedeutung gewinnen.

3.4.2.2

Menüs Menüs zählen zu den deiktischen bzw. selektionsorientierten Interaktionsformen. Bei diesen wird dem Benutzer die Möglichkeit gegeben, aus einem Angebot von Operationen bzw. Objekten auszuwählen (vgl. [ISO9241-14] S. 5). Damit wird das Konzept der Wiedererkennung unterstützt. Dieses basiert darauf, dass ein Mensch bei der Erkennung deutlich leistungsfähiger als bei der Erinnerung ist.

Menüs sind eine Interaktionstechnik, die schnell verstanden wird. Vor allem für Gelegenheitsbenutzer und Anfänger sind sie gut geeignet. Zu den Vorteilen gehören die leichte Erlernbarkeit, die hohe Anwendungsneutralität sowie die Vermeidung von Syntaxfehlern. Zusätzlich ist der Eingabeaufwand sehr gering. Menüs unterstützen das entdeckende Lernen , da sie bisher nicht verwendete und nicht erinnerte Alternativen sichtbar machen (vgl. [Ober94] S. 129). Nachteile sind vor allem die langsame Auswahl und der hohe Platzbedarf auf dem Bildschirm. Menüs sind nur für kleine Auswahlmengen geeignet. Ein weiterer Nachteil ist die Parameterübergabe bei Operationen. Diese sind nur durch aufwendige Kaskadierung, d.h. die Bildung von Untermenüs, oder durch einen zusätzlichen Dialog möglich. Die partielle Darstellung eines Menüs kann zu Orientierungs- und Navigationsproblemen führen.

Menüs sind eine wichtige Interaktionsform, die in fast jeder Anwendung genutzt wird. Aus diesem Grund wird ihnen in der Richtlinie ISO 9241 ein eigener Teil gewidmet.

Das Hauptproblem bei der Verwendung eines Menüs ist ihre Strukturierung. Das Ziel besteht darin, dass der Benutzer so schnell wie möglich den gesuchten Menüeintrag findet. Da meist die Anzahl der verfügbaren Optionen zu hoch ist, um effizient in einem einzigen Menü angezeigt zu werden, ist die Bildung eines hierarchischen Menübaums erforderlich (vgl. [ISO9241-14] S. 7). Jede zusammen angezeigte Gruppe von Menüeinträgen wird als Menü bzw. Untermenü bezeichnet. Unter der Tiefe eines Menüs versteht man die vorhandene Anzahl von Untermenüs. Die Breite eines Menüs gibt die Anzahl von Menüpunkten der aktuellen Ebene an.

Üblicherweise werden Menüpunkte nach ihrer inhaltlichen Zusammengehörigkeit gruppiert. Das Ziel sollte eine breite Menühierarchie sein, da die Suche deutlich schneller als in tiefen Hierarchien ist. Hier tritt ein Zielkonflikt ein, da der Entwickler in Versuchung gerät, inhaltlich relativ unabhängige Optionen in einem Menü zu gruppieren. Dem ist jedoch entgegenzuwirken, da bei unlogischer Strukturierung der Zeitvorteil der breiten Hierarchie verloren geht. Um den Entwickler bei diesen Entscheidungen zu unterstützen, wurden umfangreiche Untersuchungen durchgeführt. Shneiderman fasst diese zusammen und gibt einige Empfehlungen (vgl. [Shne98] S. 257). Grundsätzlich sollte ein Menü aus mindestens drei, maximal jedoch 20 Einträgen bestehen. Bei der Verwendung von relativ vielen Menüeinträgen ist sind Separatoren bzw. Trennlinien einzusetzen (vgl. [Prei99] S. 103). Diese führen zu Untergruppen und beeinflussen die Suchzeit ebenfalls positiv. Die durchschnittliche Tiefe von Menüs sollte zwischen zwei und drei liegen. Werden mehr Ebenen genutzt, so kann das eine Desorientierung des Benutzers nach sich ziehen. Ein Problem tritt auf, wenn bei der Entwicklung des Systems die Anzahl der Menüeinträge noch nicht bekannt ist. In diesen Fällen sollten Maßnahmen getroffen werden, welche die Bildung von schlechten Menühierarchien vermeiden. So kann beispielsweise eine Aufteilung in mehrere Spalten erwogen werden, oder dem Benutzer selbst die Möglichkeit der Anpassung gegeben werden (vgl. Abschnitt 3.4.8).